Spis treści:

Dowiedz się: Zawód projektanta gier od podstaw do poziomu PRO

Dowiedz się więcejDźwięk i muzyka odgrywają kluczową rolę w kinie interaktywnym, tworząc głębokie zanurzenie w fabule. Aby osiągnąć maksymalne zanurzenie, studia opracowują specjalistyczne systemy projektowania dźwięku. Podczas GDC 2023 Barney Pratt, starszy projektant dźwięku w Supermassive Games, wygłosił prelekcję na temat tworzenia realistycznego i nastrojowego udźwiękowienia do pierwszego sezonu The Dark Pictures Anthology. W swojej prezentacji szczegółowo opisał systemy dźwiękowe i elementy muzyczne opracowane przez jego zespół, wyraźnie ilustrując ich wpływ na odbiór gry.

Zespół redakcyjny Gamedev Skillbox Media przedstawia kluczowe spostrzeżenia projektanta dźwięku. W branży gier dźwięk odgrywa kluczową rolę w tworzeniu atmosfery i ulepszaniu rozgrywki. Profesjonalny projektant dźwięku odpowiada za opracowywanie i wdrażanie rozwiązań audiowizualnych, które pomagają graczom zanurzyć się w świecie gry. Wysokiej jakości dźwięk może wywoływać emocje, podkreślać działania postaci i tworzyć niepowtarzalną atmosferę. Należy pamiętać, że kompetentne projektowanie dźwięku wymaga nie tylko umiejętności technicznych, ale także kreatywnego podejścia. Dlatego projektowanie dźwięku jest integralną częścią projektowania gier, przyczyniając się do tworzenia zapadających w pamięć i angażujących projektów.

Niniejszy artykuł zawiera spoilery dotyczące pierwszego sezonu The Dark Pictures Anthology. Omówiono kluczowe wątki fabularne i ważne zwroty akcji, które mogą wpłynąć na odbiór gry. Antologia Dark Pictures to seria interaktywnych gier grozy, w których gracze podejmują decyzje wpływające na fabułę i losy postaci. Pierwszy sezon zawiera kilka wciągających historii, z których każda eksploruje inne aspekty strachu i ludzkiej psychologii. Gracze zmierzą się z dylematami moralnymi i niebezpieczeństwami, które sprawiają, że każda gra jest wyjątkowa. Przyjrzyjmy się kluczowym wydarzeniom i postaciom, które pozostawiły niezapomniane wrażenie w pierwszym sezonie.

Lista terminów wymienionych w raporcie

5.1 to najpopularniejszy system dźwięku przestrzennego, który zapewnia immersyjne wrażenia dźwiękowe. Obejmuje pięć kanałów o pełnej częstotliwości i jeden kanał dla efektów o niskiej częstotliwości. Taka konfiguracja tworzy immersyjne wrażenia dźwiękowe, idealne do oglądania filmów i słuchania muzyki. System 5.1 zapewnia wysoką jakość dźwięku i realistyczne wrażenia, co czyni go preferowanym wyborem dla systemów kina domowego i audiofilów.

Wysyłka Aux w Wwise to dodatkowy sygnał wyjściowy, który pozwala obiektom wysyłać dźwięk z indywidualnie regulowaną głośnością do oddzielnej grupy dźwięków. Ta funkcja jest szeroko stosowana do dodawania efektów specjalnych, takich jak pogłos czy echo, do różnych źródeł dźwięku. Korzystanie z wysyłek Aux pomaga stworzyć bogatszy i bardziej wielowarstwowy pejzaż dźwiękowy, poprawiając ogólne wrażenia z odtwarzania utworów audio. Dzięki elastycznej regulacji głośności, wysyłki Aux są niezbędnym narzędziem dla projektantów dźwięku i kompozytorów w tworzeniu interaktywnego dźwięku.

HDR w audio to technika miksowania, która pozwala uzyskać szeroki i zróżnicowany zakres częstotliwości, zbliżony do naturalnego. Dzięki tej technologii dźwięk staje się bogatszy i bardziej przestrzenny, zapewniając słuchaczom wyjątkowe wrażenia z odbioru muzyki i efektów dźwiękowych. HDR umożliwia precyzyjne dostrojenie parametrów audio, co pozwala na głębsze zanurzenie się w przestrzeni audio.

RTPC, czyli Real-Time Parameter Controls, to ustawienia parametrów w czasie rzeczywistym używane w silniku audio Wwise. Ustawienia te pozwalają kontrolować fragmenty audio i ich zachowanie w zależności od różnych warunków gry. Zintegrowanie RTPC ze standardowymi sekwencjami dźwiękowymi Unreal Engine umożliwia głębszą adaptację dźwięku do rozgrywki, zwiększając immersję gracza i tworząc dynamiczny dźwięk. Wykorzystanie RTPC w projektach Unreal Engine pozwala programistom tworzyć bardziej interaktywne i adaptacyjne audio, co pozytywnie wpływa na ogólne wrażenia z rozgrywki. W dźwięku przestrzennym Wwise azymut to kąt między słuchaczem a obiektem gry, rzutowany na płaszczyznę poziomą. Wartość 0° oznacza, że dźwięk dochodzi bezpośrednio przed słuchaczem. Wartość -90° oznacza, że dźwięk jest odbierany z lewej strony, a 90° oznacza, że dźwięk jest odbierany z prawej strony. Kąty +/- 180° oznaczają, że dźwięk jest odtwarzany za słuchaczem. Zrozumienie azymutu w dźwięku przestrzennym pozwala na tworzenie bardziej realistycznych pejzaży dźwiękowych w grach i innych mediach, zwiększając immersję i interakcję użytkownika ze światem wirtualnym.

Tłumienie to proces pozycjonowania dźwięków w środowisku wirtualnym tak, aby niektóre dźwięki były odbierane przez graczy ze stałą głośnością, podczas gdy inne stają się cichsze i narastają wraz ze zbliżaniem się gracza. Ta technika odgrywa kluczową rolę w tworzeniu realistycznego środowiska dźwiękowego, umożliwiając graczom lepszą nawigację w przestrzeni i zwiększając immersję. Skuteczne tłumienie efektów dźwiękowych pomaga stworzyć dynamiczną percepcję słuchową, co poprawia wrażenia z gry i sprzyja głębszej interakcji ze światem wirtualnym.

Przyciszanie to proces zmniejszania głośności jednej ścieżki audio w celu poprawy słyszalności innej. Ta metoda jest często stosowana w produkcji audio w celu stworzenia równowagi między różnymi elementami dźwięku, zapewniając czystsze i bardziej harmonijne brzmienie. Ducking może poprawić percepcję muzyki, mowy lub innych efektów dźwiękowych, co czyni go ważnym narzędziem w miksowaniu i masteringu ścieżek audio.

Dyfrakcja dźwięku to zjawisko, w którym fala dźwiękowa omija małe przeszkody o wymiarach równych lub mniejszych od długości fali. Ta właściwość dźwięku pozwala mu rozchodzić się poza przeszkody, tworząc efekt słyszalności w obszarach, w których dźwięk wydawałby się być blokowany. Dyfrakcja odgrywa ważną rolę w akustyce i pomaga wyjaśnić, dlaczego słyszymy dźwięk zza narożników lub zza ścian. Zrozumienie tego procesu jest przydatne nie tylko w badaniach naukowych, ale także w zastosowaniach praktycznych, takich jak projektowanie systemów akustycznych i poprawa jakości dźwięku w pomieszczeniach.

Mikrofon kardioidalny to rodzaj mikrofonu kierunkowego charakteryzującego się charakterystyką kierunkową przypominającą kształt serca. Mikrofon ten skutecznie wychwytuje dźwięk dochodzący z przodu, jednocześnie odrzucając hałas dochodzący z boków i tyłu. Ze względu na swoją konstrukcję, mikrofony kardioidalne idealnie nadają się do nagrywania wokali i instrumentów w hałaśliwym otoczeniu, zapewniając wysoką jakość dźwięku. Mikrofony kardioidalne są powszechnie używane w nagraniach studyjnych, występach na żywo i transmisjach, co czyni je niezbędnymi w świecie produkcji audio.

Mikrofon hiperkardioidalny to rodzaj mikrofonu kierunkowego, który charakteryzuje się węższą charakterystyką kierunkową niż mikrofon kardioidalny. Dzięki temu mikrofony hiperkardioidalne idealnie nadają się do nagrywania dźwięku w środowiskach, w których konieczne jest zminimalizowanie hałasu tła i uwypuklenie określonych źródeł dźwięku. Dzięki swojej konstrukcji mikrofony hiperkardioidalne skutecznie przechwytują dźwięk skierowany w ich stronę, co czyni je popularnymi w nagraniach studyjnych, występach na żywo i transmisjach.

Mikrofon kierunkowy to specjalny rodzaj mikrofonu, który charakteryzuje się zwiększoną czułością na dźwięk dochodzący z jednego określonego kierunku. Mikrofony te minimalizują przechwytywanie hałasu z innych kierunków, co czyni je idealnymi do nagrywania głosów i dźwięków w środowiskach, w których redukcja hałasu tła jest niezbędna. Mikrofony kierunkowe są szeroko stosowane w różnych dziedzinach, w tym w nagrywaniu dźwięku, filmie i telewizji, ze względu na ich zdolność do dokładnego przechwytywania dźwięku z określonego źródła, co znacznie poprawia jakość nagrania.

Panorama dźwięku to proces dystrybucji sygnału audio na kanał lewy, prawy i centralny (LCR). W zależności od pozycji słuchacza, panorama uwydatnia dźwięki z jednej strony, tworząc efekt przestrzenny. To rozwiązanie techniczne pomaga poprawić percepcję muzyki i projektowanie dźwięku, zapewniając bardziej immersyjne wrażenia dźwiękowe.

Pogłos to stopniowy spadek natężenia sygnału dźwiękowego, gdy odbija się on od powierzchni w pomieszczeniu. Zjawisko to odgrywa ważną rolę w akustyce i wpływa na percepcję dźwięku. Pogłos może tworzyć wrażenie przestrzeni i głębi w nagraniach muzycznych i efektach dźwiękowych. Zrozumienie pogłosu może poprawić jakość dźwięku w różnych systemach audio i salach koncertowych.

Sidechain to metoda sterowania parametrami jednego kanału lub urządzenia za pomocą innego urządzenia lub sygnału. Ta technika jest szeroko stosowana w produkcji audio do tworzenia unikalnych efektów i dynamicznego przetwarzania dźwięku. Sidechain pozwala na przykład na redukcję głośności jednego utworu w zależności od poziomu sygnału innego, co pomaga uzyskać czystszy i bardziej zrównoważony miks. Wykorzystanie sidechain otwiera nowe możliwości dla inżynierów dźwięku i muzyków, pozwalając im eksperymentować z dynamiką i fakturą dźwięku.

Kompresja sidechain to metoda przetwarzania dźwięku, która redukuje głośność jednego sygnału audio, podczas gdy inny jest aktywny. Technika ta opiera się na hierarchii kanałów, co pozwala na wzmocnienie niektórych dźwięków w zależności od kontekstu gry. Kompresja sidechain jest szeroko stosowana w produkcji muzycznej i projektowaniu gier do tworzenia dynamicznego i zrównoważonego dźwięku, poprawiając percepcję treści audio i jej jakość.

Słuchacz w silniku audio Wwise to obiekt pełniący funkcję wirtualnego mikrofonu. Jego głównym zadaniem jest rozdzielanie przychodzących dźwięków pomiędzy głośniki w oparciu o ich położenie w scenie 3D. Tworzy to realistyczne środowisko dźwiękowe, w którym dźwięki są odbierane w oparciu o odległość i kierunek, znacznie poprawiając immersję użytkownika w środowisku gry. Prawidłowe skonfigurowanie słuchacza w Wwise jest kluczem do uzyskania wysokiej jakości dźwięku w grach i aplikacjach interaktywnych.

Wyciek dźwięku to zjawisko, w którym fale dźwiękowe wydostają się z urządzenia i rozchodzą się w otoczeniu. Najczęstszym przykładem wycieku dźwięku jest sytuacja, gdy muzyka ze słuchawek staje się słyszalna dla osób w pobliżu. Problem ten może wystąpić zarówno w przypadku standardowych, jak i profesjonalnych słuchawek, wpływając na jakość odsłuchu i powodując dyskomfort u osób w pobliżu. Zmniejszenie wycieku dźwięku może zwiększyć prywatność dźwięku i poprawić wrażenia słuchowe w przypadku muzyki lub treści audio.

Efekty dźwiękowe (foley) w filmach to efekty dźwiękowe dodawane do nagrań wideo w celu stworzenia bardziej realistycznej atmosfery. Dźwięki te obejmują różne odgłosy i efekty tła, takie jak szelest ubrań, kroki, chrzęst gałęzi i wiele innych dźwięków znanych nam z życia codziennego. Zastosowanie efektów dźwiękowych (foley) może znacząco poprawić odbiór filmu, zanurzając widza w akcji na ekranie i wzmacniając emocjonalny koloryt scen. Dodawanie takich efektów jest ważnym elementem procesu postprodukcji i pomaga nadać filmowi więcej życia i głębi.

Equalizacja to proces zmiany głośności poszczególnych częstotliwości sygnału audio w jego spektrum częstotliwościowym. Pozwala to na zmniejszenie lub wzmocnienie określonych częstotliwości, co wpływa na ogólne brzmienie muzyki lub dźwięku. Equalizacja jest szeroko stosowana w muzyce, nagraniach i występach na żywo w celu uzyskania pożądanego brzmienia i poprawy jakości dźwięku. Prawidłowa korekcja dźwięku pomaga podkreślić niektóre instrumenty, wokale lub stworzyć harmonijne brzmienie jako całość.

Krótko o prelegencie i treści raportu

Na początku XXI wieku Barney Pratt rozpoczął karierę jako asystent projektanta dźwięku w branży filmowej, gdzie wniósł znaczący wkład w kultowe filmy, takie jak Troja, Batman: Początek i Harry Potter i Czara Ognia. Doświadczenie w branży filmowej przygotowało go do nowej roli i wkrótce został projektantem dźwięku w EA Games. Przez prawie trzy lata odpowiadał za udźwiękowienie gier o Harrym Potterze, co pozwoliło mu wyrazić swoje kreatywne zdolności i wnieść unikalny wkład w branżę gier wideo.

Barney pracuje w Supermassive Games od prawie 15 lat, od momentu założenia studia w 2008 roku. W tym czasie, dzięki wsparciu stale rozwijającego się zespołu, opracował liczne systemy dźwiękowe dla różnych projektów firmy. Dział dźwięku składa się obecnie z 18 projektantów dźwięku oraz kierownika produkcji, który koordynuje współpracę studia z uznanym kompozytorem Jasonem Gravesem. Doświadczenie i profesjonalizm tego zespołu pozwalają Supermassive Games tworzyć wysokiej jakości projekty audiowizualne, które zdobywają uznanie graczy na całym świecie.

The Dark Pictures Anthology to interaktywna seria horrorów oferująca wielowątkowe wątki i wciągające historie osadzone w różnych okresach historycznych. Każda gra zawiera dużą liczbę przerywników filmowych i epizodów, w których gracze mogą eksplorować różnorodne lokacje. Gra jest dostępna zarówno w trybie dla jednego gracza, jak i dla wielu graczy, obsługując od 2 do 5 graczy, a także oferuje tryb kooperacji do gry ze znajomymi.

Planowanych jest osiem gier, a pierwszy sezon obejmuje cztery odcinki: Man of Medan, Little Hope, House of Ashes i The Devil in Me. Korzystając z tych gier, Barney analizuje metody rozwoju systemów dźwiękowych. W szczególności bada, jak efekty dźwiękowe i muzyka wpływają na atmosferę i interakcję gracza ze światem gry. Te aspekty są kluczowe dla stworzenia wciągającego doświadczenia w grze, co sprawia, że studiowanie projektowania dźwięku jest szczególnie ważne dla deweloperów.

- systematyzacja efektów dźwiękowych w grze z rozgałęzionymi fabułami;

- wykorzystanie proceduralnych efektów dźwiękowych dla postaci i stworzeń;

- tłumienie;

- interaktywne miksowanie: jak zbalansować wszystkie dźwięki podczas gry;

- analiza mechaniki mikrofonu kierunkowego z Epizodu IV;

- jak wzmocnić efekt dramatyczny za pomocą muzyki diegetycznej.

Systematyzacja dźwięku w grze z nieliniową narracją

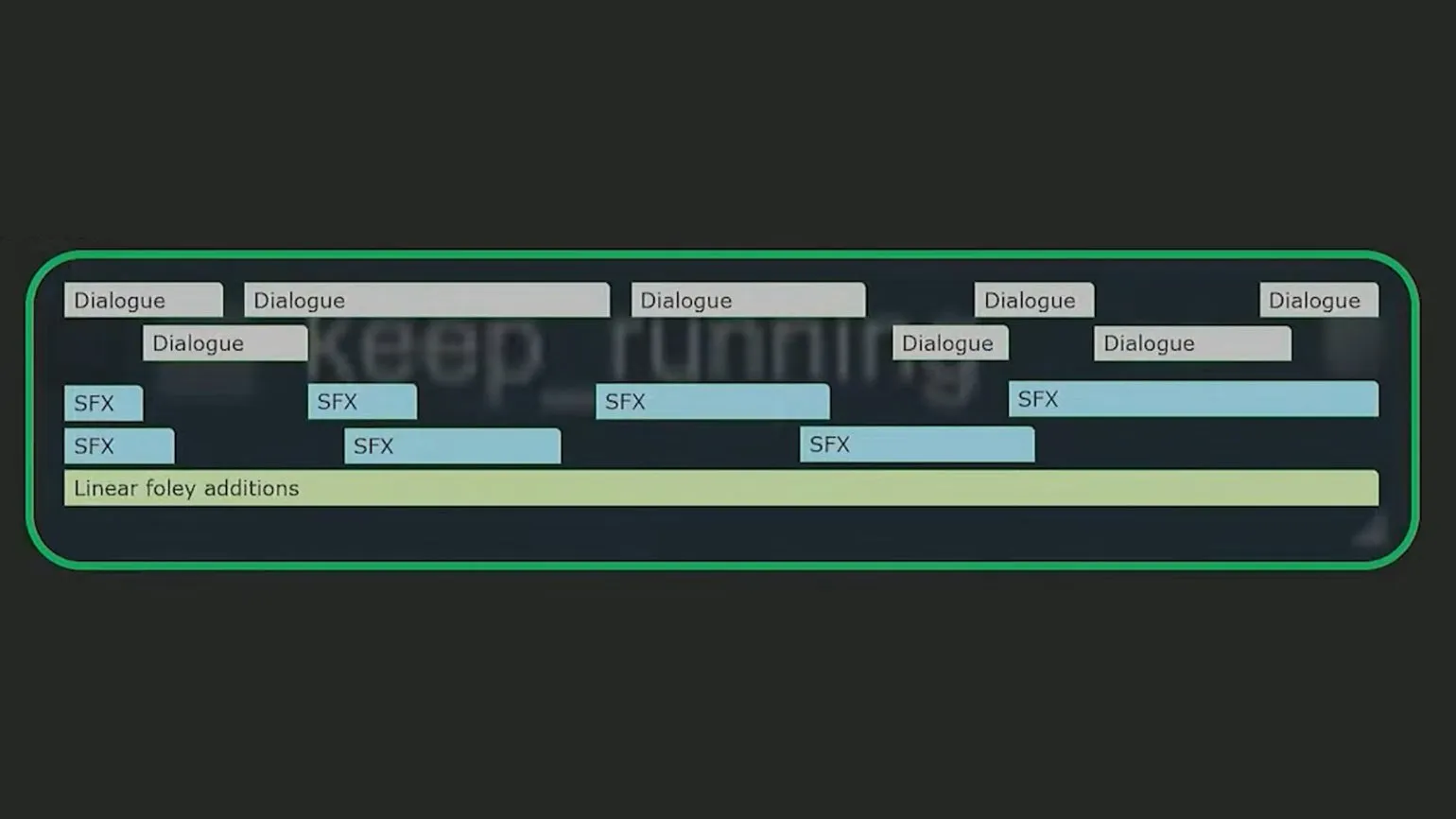

W The Dark Pictures Anthology gracz aktywnie wpływa na rozwój fabuły. Poniższe ilustracje ilustrują, jak różne wybory i działania postaci tworzą rozgałęzienia w narracji gry. Ta mechanika dodaje interaktywności i pozwala każdemu graczowi przeżyć wyjątkową przygodę, tworząc własne historie.

Зелёные ноды представляют собой кат-сцены, разработанные с zainstaluj Sequencer w Unreal Engine. Красным обозначены участки с интерактивными эпизодами, где игрок принимает решения, влияющие на развитие сюжета. Это может включать выбор диалогов i ключевых решений, а также прохождение сцен сэлементами QTE. Пустые сегменты, выделенные жёлтым цветом, содержат стандартный геймплей от третьего лица, включающий элементы исследования. Такой подход позволяет создавать более увлекательный и разнообразный игровой процесс, обеспечивая игрокам возможность влиять на ход событий i погружаться в сюжет.

W нижней части представлена inформация о звуковых эффектах, которые используются в ноде с kat-сценой. Все аудиофрагменты организованы в линейную секвенцию. В состав этой секвенции входят:

- диалоги;

- SFX, они же звуковые эфекты;

- дополнительные линейные фоли-эффекты для персонажей, которые записывались как при стандартном производстве кинокартин. По сути это минимальные дополнения, которые не были включены в процедурные звуковые системы, — например, звуки перемещения стула, трения верёвки о стену, удержания двери телом, шуршание ткани при ползании i другие редкие аудиофрагменты.

В линейных секвенциях также используются RTPC в виде кривых. В предыдущей ноде они отсутствуют, поскольку подключение RTPC осуществляется на следующем этапе, вместе с музыкальными элементами.

Pozostałe części gry, zawierające interaktywne sekwencje i elementy eksploracji, w dużym stopniu wykorzystują dźwięk systemowy. Ta metoda zapewnia płynną rozgrywkę i głębokie immersje gracza, co jest kluczowe dla ogólnej atmosfery gry. Dźwięki systemowe obejmują:

- oddech postaci i reakcje na różne wyzwania SI;

- atmosfery (sceny dźwiękowe) – grupy dźwięków i ich aranżację;

- muzykę i projektowanie dźwięku.

Proceduralne efekty dźwiękowe odgrywają kluczową rolę w projektowaniu dźwięku i obejmują wszystkie dźwięki związane z postaciami, takie jak szelest ubrań, kroki i inne elementy dźwiękowe. Efekty te znacząco zwiększają immersję w rozgrywce i tworzą bardziej realistyczną atmosferę. Szczegółowe informacje na temat efektów dźwiękowych znajdują się poniżej.

Wszystkie systemy dźwiękowe są regularnie aktualizowane, a studio inwestuje znaczne środki w ich rozwój. Systemy te pomagają zrównoważyć dźwięki postaci zarówno w przerywnikach filmowych, jak i w rozgrywce. Odgrywają one również kluczową rolę w finalizacji projektu: tworzenie gry trwa około roku, a jeśli wymagane są zmiany w projekcie dźwiękowym, ich integracja bez takich systemów staje się znacznie trudniejsza. Wykorzystanie nowoczesnych technologii dźwiękowych gwarantuje wysoką jakość dźwięku i poprawia ogólną immersję w grze.

Proceduralne efekty Foleya

W grach kinowych kluczowe jest stworzenie wciągającej postaci. Supermassive Games wykorzystuje w tym celu proceduralne efekty Foleya. Termin „foley” obejmuje szeroki zakres efektów dźwiękowych, ale w kontekście projektantów dźwięku w studiu odnosi się on do wszelkich interakcji dźwiękowych między postacią a otoczeniem. To znacząco zwiększa immersję gracza w rozgrywce i sprawia, że każda scena jest bardziej realistyczna. Użycie efektów foley pomaga stworzyć wyjątkową atmosferę i podkreśla emocje postaci, co z kolei poprawia ogólne postrzeganie gry.

Podejście proceduralne ma kilka istotnych zalet. Po pierwsze, zapewnia przejrzystość i strukturę kodu, ułatwiając jego zrozumienie i utrzymanie. Po drugie, podejście to sprzyja ponownemu wykorzystaniu kodu, ponieważ funkcje i procedury mogą być używane w różnych częściach programu. Skraca to czas programowania i zwiększa wydajność. Po trzecie, podejście proceduralne upraszcza debugowanie, ponieważ błędy można wyodrębnić dla poszczególnych procedur, co ułatwia ich wyszukiwanie i naprawę. Ponadto, zastosowanie podejścia proceduralnego sprzyja lepszemu zarządzaniu pamięcią i zasobami, co jest szczególnie ważne w przypadku tworzenia złożonych aplikacji. Podejście proceduralne jest zatem niezawodnym narzędziem do tworzenia wysokiej jakości oprogramowania.

- obejście większości efektów specjalnych;

- efekt końcowy jest łatwiejszy do sfinalizowania w ciągu rocznego rozwoju;

- oszczędność czasu i budżetu;

- stresujące sytuacje są generalnie minimalizowane;

- system nadaje się również do innych projektów, więc zwraca wszystkie koszty;

- zapewnia integralność fragmentów przerywników filmowych i rozgrywki z eksploracją, dotyczy to w szczególności efektów specjalnych broni, które zostaną omówione poniżej.

Gra House of Ashes aktywnie wykorzystuje unikalny system gry, który pozwala na głębsze zanurzenie się w fabule. Wydarzenia rozgrywają się w Iraku w maju 2003 roku, gdzie amerykańskie siły specjalne poszukują broni masowego rażenia. Zamiast oczekiwanego arsenału żołnierze natrafiają na starożytną sumeryjską świątynię zaginioną pod ziemią, zamieszkaną przez istoty pozaziemskie. Ten nieoczekiwany obrót wydarzeń dodaje napięcia i intrygi, tworząc wyjątkowe doświadczenie interakcji ze światem gry.

Przeczytaj także:

Sekrety gry House of Ashes Projekt: analiza narracji i nieliniowości. Z udziałem ekspertów. Niniejsze badanie zgłębia unikalne podejście do narracji i mechaniki gry, które umożliwia graczom podejmowanie znaczących decyzji. Eksperci dzielą się swoimi spostrzeżeniami na temat wpływu nieliniowych struktur narracyjnych na narrację i interakcje postaci. Kluczowym aspektem jest to, jak wybory gracza kształtują fabułę i tworzą zróżnicowane zakończenia, dzięki czemu każda rozgrywka jest wyjątkowa. Analizujemy, jak projektanci wykorzystali elementy horroru i dramatu, aby stworzyć napiętą atmosferę, a także jak styl wizualny i dźwięk wzmacniają immersję w świecie gry. Analizując House of Ashes, rozumiemy, jak projekt i elementy narracji są umiejętnie splecione, czyniąc tę grę kamieniem milowym w gatunku interaktywnego opowiadania historii.

Proceduralne efekty specjalne w tej grze są podzielone na kilka kategorii. W tym artykule szczegółowo przyjrzymy się każdej z nich, aby zrozumieć, jak wpływają na rozgrywkę i ogólne postrzeganie świata. Efekty te dodają realizmu i głębi, wzmacniając interakcję gracza z otoczeniem. Poznanie różnych grup efektów Foleya pomoże Ci lepiej zrozumieć ich rolę w tworzeniu przyjemnego i wciągającego doświadczenia w grach.

Kroki to sekwencyjne działania, które pomagają Ci osiągnąć określony cel. Ważne jest, aby odpowiednio zorganizować każdy krok, aby zapewnić wydajność procesu. Każdy krok powinien być jasny i zrozumiały. Pozwoli to uniknąć nieporozumień i zwiększyć produktywność. Określenie kolejności kroków pomaga lepiej kontrolować wykonywanie zadań i mierzyć postępy. Skuteczne planowanie kroków przyczynia się do pomyślnego ukończenia projektu i osiągnięcia pożądanego rezultatu.

- chodzenie i bieganie, których dźwięk jest odtwarzaniem małych plików i zależy od prędkości postaci;

- powolne chodzenie, wymagające dodatkowego dostrojenia;

- tarcie podeszwy o powierzchnię;

- lądowanie;

- ruch kończyn stworzeń.

Dźwięki kroków w House of Ashes różnią się w zależności od rodzaju powierzchni, po której porusza się postać. Gra oferuje 2630 różnych materiałów, co znacząco wzbogaca rozgrywkę i dodaje realizmu. Każdy materiał wydaje unikalny dźwięk, pozwalając graczom głębiej zanurzyć się w atmosferze gry.

Szelest tkanin generuje efekty dźwiękowe podobne do kroków, ale w tym przypadku dźwięki powstają poprzez interakcję różnych materiałów tekstylnych. Intensywność tych dźwięków zależy od stopnia zgięcia stawów, takich jak kolana i łokcie, w szkielecie modelu. Na przykład, im bardziej postać zgina łokieć podczas ruchu, tym bardziej słyszalny będzie dźwięk tarcia o ubranie. Prawidłowe ustawienie tych efektów pozwala dodać realizmu i głębi ruchom postaci, czyniąc je bardziej realistycznymi i przekonującymi w kontekście gry lub animacji.

Ekwipunek to ważny element, który obejmuje dźwięki generowane przez różne akcesoria postaci, takie jak kabury, kamizelki, biżuterię i inne detale. Dźwięki te wzbogacają ogólną atmosferę dźwiękową, dodając różnorodności i wyrafinowania. Odpowiednio dobrany sprzęt nie tylko uzupełnia obraz, ale także wzmacnia immersję w rozgrywce, czyniąc ją bardziej realistyczną i angażującą.

Broń palna w House of Ashes jest prezentowana z realistycznymi efektami dźwiękowymi, w tym odgłosami magazynka, mocowania pasa nośnego i zamka. Ten zestaw zawiera trzy rodzaje próbek o różnej prędkości: niską, średnią i wysoką. Każda próbka podkreśla detale, tworząc wciągającą atmosferę w grze. Te elementy dźwiękowe zwiększają realizm rozgrywki i czynią ją bardziej angażującą dla użytkowników.

Łatki reprezentują dźwięki wydawane przez dotykanie zewnętrznej, tylnej i bocznej powierzchni dłoni. Te efekty dźwiękowe są wciąż udoskonalane, ale obecna wersja systemu już demonstruje możliwość tworzenia realistycznych efektów dźwiękowych. Ulepszenie tych efektów jest ważne dla stworzenia głębszego i bardziej wciągającego środowiska audiowizualnego.

Skrzydła stworzeń i efekty dźwiękowe ich trzepotania są wynikiem adaptacji różnych systemów. Te unikalne mechanizmy zapewniają nie tylko siłę nośną, ale także zwrotność w locie, co jest szczególnie ważne dla przetrwania w środowisku naturalnym. Badanie efektów Foleya pozwala nam lepiej zrozumieć aerodynamikę i ewolucję skrzydeł u różnych gatunków, co ma implikacje zarówno dla biologii, jak i inżynierii.

Procedury efektów Foleya dla postaci są tworzone za pomocą emiterów dźwięku, konfigurowanych w silniku gry. W tym kontekście emitery to urządzenia przymocowane do siatki postaci, które skutecznie odtwarzają efekty dźwiękowe odpowiadające jej działaniom i ruchom. Prawidłowe rozmieszczenie i konfiguracja tych emiterów odgrywają kluczową rolę w tworzeniu immersyjnej atmosfery dźwiękowej, co znacząco poprawia ogólne postrzeganie rozgrywki.

Emitery zapewniają odtwarzanie dźwięku w czasie rzeczywistym i są konfigurowane za pomocą parametrów RTPC Wwise. Pozwala to na tworzenie realistycznie symulowanych dźwięków, które zmieniają się w zależności od ruchu postaci w świecie gry. Wykorzystanie RTPC do sterowania efektami dźwiękowymi znacznie poprawia immersję gracza w atmosferę gry.

W House of Ashes projektanci dźwięku skupili się na dźwięku przestrzennym, który skutecznie podkreśla skalę starożytnych jaskiń, wąskich tuneli i unikalnych lokacji w grze. Implementacja takiego systemu dźwiękowego jest prosta, ponieważ jest on obsługiwany przez podstawowe funkcje Wwise. Jednak biorąc pod uwagę specyfikę rozgrywki, specjaliści musieli zoptymalizować obciążenie procesora. Na przykład osiem emiterów generuje tysiące wywołań API, a gdy w scenie pojawia się wiele postaci, w tym wampiry z dwunastoma emiterami, wymagania wydajnościowe znacznie rosną. Liczne ustawienia RTPC i parametry dyfrakcji dźwięku mogą znacząco wpłynąć na ogólną wydajność gry.

Zespół opracował system przycinania, który wyświetla tylko te zdarzenia i emitery, które znajdują się w zasięgu odbiornika. Optymalizuje to wydajność i poprawia efektywność przetwarzania danych w czasie rzeczywistym. System zapewnia bardziej ukierunkowane podejście do interakcji z użytkownikiem, umożliwiając mu skupienie się na najistotniejszych informacjach.

Pauza. Wywołanie wszystkich emiterów poza zdefiniowanym obszarem odgrywa kluczową rolę w tworzeniu scen walki z udziałem różnych postaci. Barney podkreśla, że system przycinania pomógł zoptymalizować dźwięk przestrzenny, uwzględniając specyfikę każdej platformy. Na przykład liczba emiterów została zmniejszona w przypadku PlayStation 4 i Xbox One, a zwiększona w przypadku konsol nowej generacji. Pozwala to na uzyskanie wyższej jakości dźwięku i lepsze ogólne wrażenia z gry.

Podczas opracowywania proceduralnych efektów dźwiękowych projektanci dźwięku uznali, że powiadomienia o animacjach nie nadają się do krótkiego cyklu rozwojowego, trwającego zaledwie rok, ponieważ poszczególne animacje mogą się zmieniać aż do finalnej wersji. Dlatego potrzebny był elastyczny system obsługujący zarówno animacje ruchu, jak i mocap. Osiągnięto to poprzez powiązanie ustawień emiterów RTPC z ruchami postaci. Do systemu dodano nowe animacje lądowania i poruszania się po ścianach. Zespół zaimplementował również dodatkową warstwę dźwiękową do interakcji z różnymi materiałami, takimi jak ruiny, tynkowane podłogi i kałuże. W rezultacie uzyskano bogatsze i bardziej realistyczne wrażenia dźwiękowe, co można zobaczyć w filmie z krokami postaci, który uwzględnia te ustawienia.

Ta sekcja zawiera informacje o efektach dźwiękowych związanych z różnymi rodzajami broni podczas ruchu postaci. Omówiono w niej również dźwięki obiektów, które wydają podczas interakcji z nimi, oraz proceduralne efekty dźwiękowe związane z klaskaniem w dłonie. Elementy te odgrywają kluczową rolę w tworzeniu realistycznych wrażeń z gry i zanurzaniu gracza w wirtualnym świecie.

W poniższym filmie można usłyszeć proceduralne dźwięki postaci, w tym szelest tkanin i sprzętu. Dźwięki te, choć mniej słyszalne, organicznie uzupełniają ogólną oprawę dźwiękową. Odgłosy kroków i trzepotu skrzydeł stworzeń są zaimplementowane w podobny sposób.

W House of Ashes szczególny nacisk położono na wampiry z kosmosu. Użycie standardowych ścieżek dźwiękowych do ich udźwiękowienia okazało się niepraktyczne, ponieważ gra zawiera ponad tysiąc unikalnych scen z udziałem tych stworzeń. W rezultacie twórcy stworzyli własny system efektów foley, który zapewnia szeroki wachlarz akcji. Co więcej, ruchy wampirów zostały zrealizowane nie tylko za pomocą animacji poklatkowej, ale także technologii motion capture (mocap). Dzięki temu możliwe było osiągnięcie wysokiego poziomu realizmu i ekspresji postaci w grze.

Przykład cyklicznej animacji chodu wampira demonstruje unikalny sposób poruszania się tego mitycznego stworzenia. Chociaż w tym przypadku wampir porusza się na czworakach, w niektórych scenach używa tylko tylnych kończyn, które są zaprojektowane jak koń, uzupełnione o dodatkowy staw dla większej mobilności. Ponadto wampiry mają skrzydła, co nadaje ich ruchom szczególnej gracji i dramatyzmu. Ta animacja zapewnia głębsze zrozumienie fizyki i charakteru wampirów, co jest ważne dla tworzenia realistycznych obrazów w różnych formatach multimedialnych.

Anatomiczne cechy wampirów nie pozwoliły na pełną adaptację systemu emiterów używanego dla postaci ludzkich. Zamiast tego zespół skupił się na dostosowaniu proceduralnych efektów kroków i szelestu tkanin do nowego modelu. Zaprojektowanie skrzydeł wymagało opracowania systemu proceduralnego od podstaw, ale wykorzystano technologie podobne do tych stosowanych w przypadku postaci ludzkich. Krzyki i syki wampirów zostały wykonane ręcznie, przy użyciu sprawdzonych technik. Projektanci dźwięku wykonali niesamowitą pracę, zwracając szczególną uwagę na każdy szczegół, aby uzyskać jak najbardziej realistyczny dźwięk dla tych stworzeń. Zalecamy sprawdzenie końcowego rezultatu.

Prezentujemy kolejny przykład sekwencji wideo z wampirami, z pełnym akompaniamentem dźwiękowym i muzycznym. Ten film zanurza widzów w atmosferze tajemnicy i grozy, nieodłącznie związanej z tematyką wampirów. Muzyka i efekty dźwiękowe wzmacniają percepcję, zapewniając widzom niepowtarzalne wrażenia.

Miksowanie interaktywne

Reżyserzy dźwięku wykonują kilka kluczowych kroków w procesie tworzenia dźwięku wysokiej jakości. Pierwszym krokiem jest nagranie dźwięku, gdzie ważne jest prawidłowe ustawienie sprzętu i dobór odpowiednich mikrofonów. Następnie następuje etap edycji, podczas którego realizatorzy dźwięku przetwarzają nagrane ścieżki, usuwając zbędne szumy i dodając efekty. Następnie następuje miksowanie, podczas którego wszystkie elementy dźwiękowe są łączone w jedną całość, aby uzyskać harmonijne brzmienie. Ostatnim etapem jest mastering, podczas którego przygotowywana jest ostateczna wersja utworu do wydania i zapewniana jest optymalna jakość dźwięku na różnych platformach audio. Te kroki umożliwiają projektantom dźwięku tworzenie profesjonalnych nagrań audio spełniających wysokie standardy jakości.

- Miksowanie efektów dźwiękowych w całym procesie z wykorzystaniem współdzielonych zasobów dla postaci w przerywnikach filmowych i fragmentach rozgrywki eksploracyjnej;

- Panorama z 50% przesunięciem środka;

- Praca z tłumieniem w celu stworzenia akcentu;

- Przesuwanie pozycji słuchacza, niezależnie od pozycji gracza/kamery;

- Używanie sidechainu zamiast HDR.

Ten zestaw funkcji zapewnia harmonijną interakcję wszystkich systemów dźwiękowych, tworząc efekt immersji.

Podczas etapu panoramowania dialogów zespół Barney'a stanął przed poważnym wyzwaniem. Ze względu na dynamiczne kąty kamery, pozycja kamery stale się zmieniała podczas rozmów, co powodowało niestabilne przesuwanie kamery z jednej strony na drugą. Istniały dwa sposoby rozwiązania tego problemu.

- Odtwarzaj wszystkie dialogi tylko przez głośnik centralny, tak jak w filmach poprzedniej generacji. Jednak takie rozwiązanie sprawiłoby, że dźwięk brzmiałby bez życia, ponieważ brakowałoby kierunkowości typowej dla gier.

- Przesuwanie kamery w systemie 5.1 zapewniałoby doskonałą kierunkowość dźwięku, ale skutkowałoby poważnym przycinaniem niektórych efektów, co również zaburzałoby immersję gracza.

Projektanci dźwięku osiągnęli kompromis między tymi dwoma podejściami. Dostosowali przesuwanie kamery dla wszystkich dialogów i efektów dźwiękowych, zmniejszając ich intensywność o połowę. To rozwiązanie poprawiło dźwięk i stworzyło bardziej harmonijną atmosferę w utworze.

W rezultacie opracowano system z 50-procentowym przesunięciem środka. W praktyce oznaczało to, że jeśli postać wydawała dźwięk poza strefą centralną, położenie źródła dźwięku pozostawało niezmienne względem słuchacza, ale dźwięk był odtwarzany z uwzględnieniem nowego przesunięcia panoramy. Głośnik centralny zmieniał swoje położenie, ale nie miał bezpośredniego połączenia z konkretnym dźwiękiem. Poniższe przykłady pokazują, że wartość panoramowania dźwięku jest proporcjonalna do położenia emitera w grze, co pomaga stworzyć bardziej realistyczną atmosferę dźwiękową.

Gdy obiekt emitujący dźwięk znajduje się w polu widzenia gracza, sygnały audio są przesyłane przez głośnik centralny. Panoramowanie dźwięku zależy od położenia obiektu względem lewej lub prawej strony. Takie podejście nie tylko eliminuje nagłe zmiany dźwięku przy zmianie kąta kamery, ale także zwiększa zaangażowanie gracza, poprawiając ogólną immersję. Byłoby to niemożliwe, gdyby dialogi były odtwarzane wyłącznie przez głośnik centralny.

Im bliżej słuchacza znajdują się emitery dźwięku, tym więcej szczegółów i niuansów percepcji dźwięku można dostrzec. Poniższa infografika przedstawia gradację tłumienia głośności różnych dźwięków w zależności od odległości od słuchacza, który znajduje się w pobliżu kamery. Informacje te są istotne dla zrozumienia cech akustycznych i optymalizacji projektowania dźwięku w różnych środowiskach.

Diagram pokazuje, że gdy postać znajduje się w znacznej odległości od słuchacza, dźwięki szelestu tkanin, sprzętu i broni nie są słyszalne. Jednak efekty dźwiękowe kroków pozostają słyszalne, pomagając utrzymać poczucie obecności i połączenia z otoczeniem. Kwestie postaci są zawsze słyszalne, niezależnie od odległości, ponieważ odgrywają kluczową rolę w rozwoju fabuły. To tworzy głębszą immersję w grze i wzmacnia emocjonalną więź między graczem a postaciami.

Gdy słuchacz znajduje się blisko postaci, będzie mógł usłyszeć dźwięki szelestu tkanin i akcesoriów, tworząc wrażenie bezpośredniego kontaktu. To wzmacnia immersję i sprawia, że interakcje są bardziej realistyczne. Projektowanie dźwięku odgrywa kluczową rolę w tworzeniu poczucia intymności i zaangażowania w to, co się dzieje.

Podczas odłączania słuchacza, zmieniając położenie kamery i przesuwając ją w dowolne miejsce w świecie gry, uzyskuje się efekt podobny do znanej techniki filmowej, w której widz staje się niewidzialnym obserwatorem rozmów postaci. Technika ta jest często stosowana w scenach, w których postacie komunikują się w zamkniętych przestrzeniach, takich jak kawiarnie czy samochody, a kamera rejestruje je z zewnątrz. Ta technika tworzy atmosferę intrygi i pozwala widzowi poczuć się częścią akcji, co wzmacnia immersję w fabułę i emocjonalną więź z postaciami.

To podejście skutecznie rozwiązuje problemy związane z okluzją, która występuje, gdy dźwięk nie może przedostać się przez przeszkodę. W takich przypadkach przestrzenna fala dźwiękowa nie dociera do kamery. Ta technika poprawia jakość dźwięku i tworzy bardziej realistyczny pejzaż dźwiękowy, co jest szczególnie ważne w przypadku projektów audiowizualnych i rzeczywistości wirtualnej.

Aby stworzyć graczowi niekomfortową sytuację, dźwięki można wykorzystać nie tylko zdystansowanego słuchacza, ale także z otoczenia. Ta technika jest szczególnie skuteczna w scenach, w których postać, na przykład zabójca, podsłuchuje rozmowę, ukrywając się za krzakiem. W takich sytuacjach projektowanie dźwięku wzmacnia atmosferę i napięcie, pozwalając graczowi bardziej wciągnąć się w rozgrywkę. Schematycznie można to przedstawić następująco.

Należy pamiętać, że te ustawienia są przeznaczone wyłącznie do tworzenia efektów foley. Dialogi są regulowane osobno i w każdym przypadku dialogi zawsze będą miały przewagę nad innymi stłumionymi dźwiękami. Zapewnia to wyraźną słyszalność dialogów, co jest ważnym aspektem w treściach audiowizualnych. Prawidłowe skonfigurowanie efektów foley i dialogów pomaga stworzyć bardziej realistyczne środowisko dźwiękowe i poprawia odbiór sceny przez publiczność.

Standardowa hierarchia ścieżek audio stosowana przez realizatorów dźwięku obejmuje fragmenty priorytetowe umieszczone na górze. Specjaliści stosują różne kombinacje sidechainów, takie jak tłumienie, korekcja częstotliwości, co jest szczególnie ważne w przypadku dialogów, a także kompresja sidechainów wykonywana z płynnymi przejściami. Techniki te pomagają tworzyć zrównoważony i wysokiej jakości dźwięk w produkcjach audio, zapewniając jego klarowność i wyrazistość.

Podczas miksowania dźwięku mogą dominować dźwięki o niskim priorytecie, ponieważ ważniejsze sygnały dźwiękowe są czasami przerywane. Pozwala to zespołowi manipulować przestrzenią dźwiękową, dostosowując ją do pożądanych efektów kinowych. Takie podejście pomaga stworzyć unikalną atmosferę w filmie, skutecznie skupiając uwagę widza na kluczowych momentach.

W Little Hope projektanci dźwięku zaimplementowali unikalny efekt, który przekształca dźwięk diegetyczny, gdy postacie poruszają się we mgle. Efekt ten można było dostosować za pomocą różnych wtyczek i ustawień RTPC. W tym odcinku zespół dostosował również wysokość dźwięku wszystkich elementów atmosferycznych, aby skutecznie oddać stan psychiczny bohatera. Dzięki temu gracze mogli przeżyć przerażające chwile o zwiększonej intensywności, co stworzyło efekt zmieniający rzeczywistość.

Przykład sceny akcji na łodzi z filmu „Diabeł we mnie” pokazuje wysoki poziom dynamiki i napięcia. Ta sekwencja zawiera mnóstwo akcji, które utrzymują gracza w napięciu i skupieniu. Scena skutecznie buduje atmosferę napięcia, dzięki czemu rozgrywka staje się bardziej ekscytująca i wciągająca.

W strukturze dźwięku każdy sygnał audio pełni unikalną rolę w utworach. Na przykład silnik łodzi, oznaczony jako „Pętle silnika łodzi”, pracuje nieprzerwanie, ale od czasu do czasu zwiększa obroty. Osiąga się to za pomocą osobnego efektu dźwiękowego, oznaczonego na schemacie jako „Obroty silnika”. Te sygnały dźwiękowe wypełniają luki między głównymi ścieżkami kluczowych efektów dźwiękowych, tworząc pełniejsze i bardziej realistyczne środowisko dźwiękowe.

Scena rozgrywa się na jeziorze, gdzie słychać dźwięki wody obmywającej kadłub łodzi. W miarę rozwoju akcji postacie wyskakują z łodzi, tworząc imponujące pluski i chlapanie. Te elementy dźwiękowe wzmacniają atmosferę i sprawiają, że scena jest bardziej realistyczna, dzięki czemu widzowie wciągają się w akcję.

W intensywnych scenach akcji, projektowanie dźwięku odgrywa kluczową rolę. Dźwięki walki, takie jak ciosy, kopnięcia i broń biała, muszą być wyraźne i wyraziste. Każdy fragment audio musi harmonijnie łączyć się z pozostałymi, tworząc dynamiczną i wciągającą atmosferę, nawet przy wielu ścieżkach audio. Efektywny dźwięk wzmacnia akcję i sprawia, że scena jest bardziej realistyczna i angażująca dla widzów.

Inżynierowie dźwięku zaimplementowali kilka dodatkowych submiksów dźwiękowych, Szczegółowy opis można znaleźć tutaj. Zapraszamy do obejrzenia galerii poniżej. Pozwoli ci to lepiej zrozumieć cechy projektu dźwiękowego i ocenić jakość pracy specjalistów.

Ta scena jest częścią interaktywnego filmu, co oznacza, że nie wszystkie postacie mogą być w niej reprezentowane. Nawet jeśli bohaterom uda się pokonać trudności i dotrzeć na statek, ich losy mogą być zarówno tragiczne, jak i pomyślne w tej scenie. W trakcie gry gracze mogą zbierać różne przedmioty, które znacząco wpłyną na losy postaci. Scena zawiera również wspomniane wcześniej efekty tłumienia i zwolnionego tempa, które zmieniają krajobraz dźwiękowy i tempo percepcji. Inżynierowie dźwięku wykonali znaczną pracę, miksując interaktywnie, uwzględniając wszystkie te aspekty. Poniżej znajduje się fragment jednej z możliwych wersji tej sceny w grze.

Mikrofon kierunkowy

Jedną z kluczowych cech gry The Devil in Me jest mikrofon kierunkowy. Funkcja ta pozwala graczom na skuteczniejszą interakcję z otoczeniem i odkrywanie nowych aspektów rozgrywki. Mikrofon kierunkowy wzmacnia efekty dźwiękowe, pozwalając na lepsze uchwycenie ważnych dźwięków i szeptów, które mogą wpłynąć na rozwój fabuły. Ten element nie tylko zwiększa poziom immersji w atmosferze gry, ale także dodaje aspekt strategiczny, ponieważ gracze muszą zwracać uwagę na dźwięki dochodzące z różnych kierunków. To sprawia, że doświadczenie z gry jest bardziej wciągające i interaktywne, zwracając uwagę zarówno na szczegóły fabuły, jak i mechanikę interakcji ze światem.

- jego obecność jest determinowana przez narrację i jedną z kluczowych mechanik rozgrywki, ponieważ zgodnie z fabułą, urządzenie to jest używane przez projektantkę dźwięku Erin;

- mikrofon jest kontrolowany przez gracza;

- jest powiązany z widokiem trzecioosobowym;

- działa na zasadzie mikrofonu typu shotgun.

Aby zaimplementować tę kluczową funkcję, zespół musiał stworzyć symulację urządzenia w grze i określić wymagany wzór mikrofonu — kardioidalny lub hiperkardioidalny. Było to ważne dla wzmocnienia poczucia strachu i klaustrofobii u graczy. Projektanci dźwięku symulowali tłumienie pozaosiowe mikrofonu, dostosowując urządzenie wirtualne tak, aby ignorowało dźwięki poza jego strefą kierunkową. Rezultatem jest realistyczny efekt wycieku dźwięku i pogłosu, znacznie zwiększający immersję w atmosferę gry.

Podczas rozgrywki Erin może w dowolnym momencie zakładać i zdejmować słuchawki, co pozwala na zapisywanie wszystkich ustawień RTPC w czasie rzeczywistym. Zapewnia to płynne wrażenia dźwiękowe. Dodatkowo, uchwyt mikrofonu jest wyposażony w proceduralne efekty dźwiękowe podobne do tych używanych w przypadku broni. Tworzy to realistyczną symulację niepożądanych dźwięków tła, które mogą występować podczas nagrywania, ale są obecne w rzeczywistości.

W Wwise ustawienia mikrofonu kierunkowego są prezentowane w przyjaznym dla użytkownika interfejsie, umożliwiając łatwą regulację parametrów nagrywania. Ustawienia te obejmują wybór typu mikrofonu, regulację głośności oraz możliwość stosowania filtrów w celu poprawy jakości dźwięku. Dzięki intuicyjnej konstrukcji użytkownicy mogą szybko dostosować dźwięk do potrzeb projektu, co czyni Wwise idealnym narzędziem do profesjonalnej produkcji dźwięku. Prawidłowe ustawienie mikrofonu kierunkowego w programie Wwise znacząco wpływa na jakość nagrywanego dźwięku, umożliwiając osiągnięcie najlepszych rezultatów w projektowaniu dźwięku.

Zespół Barneya pracował nad wspomnianymi wcześniej ustawieniami azymutu. Diagram mikrofonu pokazuje ostrzejsze krzywe, a dodatkowa krzywa Aux Send została dodana. Projektanci dźwięku doszli do wniosku, że w kontekście rozgrywki azymut powinien zależeć od kierunku kamery, a nie postaci, ponieważ można ją obrócić w stronę gracza. Poniższy film pokazuje, jak w praktyce działa mechanika mikrofonu kierunkowego.

Muzyka diegetyczna

Muzyka diegetyczna to kompozycje, które organicznie wpisują się w kontekst gry lub filmu, czyniąc je słyszalnymi dla postaci. Ścieżkę dźwiękową do pierwszego sezonu antologii The Dark Pictures stworzył kompozytor Jason Graves. Utwory muzyczne w tym projekcie kładą nacisk na tempo i fabułę, a także koncentrują się na lokacjach i epokach historycznych. Niniejszy tekst zawiera krótki przegląd oprawy muzycznej każdego odcinka, ukazując cechy i atmosferę poszczególnych utworów.

- Akcja „Man of Medan” rozgrywa się na południowym Pacyfiku, a ścieżka dźwiękowa w trzech czwartych składa się z kompozycji w stylu wave. Jednak gdy bohaterowie znajdują się na statku widmo, słychać partie orkiestrowe i fortepianowe.

- Akcja „Little Hope” rozgrywa się w fikcyjnym mieście o tej samej nazwie, ale sam scenariusz został napisany w oparciu o wydarzenia związane z procesami i egzekucjami „czarownic” w amerykańskim Salem w 1692 roku. Scena dźwiękowa była bardziej minimalistyczna, a aby ją stworzyć, zespół zbadał specyfikę instrumentów muzycznych z końca XVII wieku.

- Narracja „House of Ashes” rozpoczyna się w czasach starożytnych Sumerów, a następnie gwałtownie przenosi się do wydarzeń rozgrywających się w Iraku na początku XXI wieku. Partie orkiestrowe ustępują miejsca syntezowanym kompozycjom z motywami typowymi dla gatunków fantasy, ponieważ wampiryczne istoty są przedstawicielami obcej rasy.

- Akcja „The Devil in Me” rozgrywa się w Chicago w 1892 roku. Ścieżka dźwiękowa tego odcinka jest inspirowana twórczością amerykańskiego kompozytora Bernarda Herrmanna, autora muzyki do filmów Hitchcocka. W „The Devil in Me” znajdują się również fragmenty muzyki klasycznej i arie operowe, akcentowane aleatorycznymi technikami orkiestrowymi dla wzmocnienia dramatyzmu.

Oto wybór utworów muzycznych z pierwszego sezonu „The Dark Pictures Anthology”. Pełne wersje ścieżek dźwiękowych do każdego odcinka są dostępne do odsłuchania na stronie kompozytora na Spotify. Odkryj nastrojowe melodie, które podkreślają napięcie i emocjonalną głębię każdej historii.

Zespół Barneya opracował system, który znacząco wzmacnia dramaturgię muzyki diegetycznej. Początkowo fragmenty utworów klasycznych i arii operowych odtwarzano w mono z gramofonu, ale wkrótce zaczęto odtwarzać je w stereo. Aby uzyskać ten efekt, realizatorzy dźwięku wykorzystali trzy kluczowe parametry RTPC w programie Wwise. Te ustawienia zapewniły głębsze zanurzenie w muzycznej atmosferze, co przyczyniło się do stworzenia unikalnych wrażeń dźwiękowych dla słuchaczy.

- miksowanie plików mono i stereo;

- wprowadzanie pogłosu w celu podkreślenia określonych momentów;

- kontrola zniekształceń, jeśli zachodziła potrzeba celowego zepsucia kompozycji w krytycznych momentach.

Wszystkie fragmenty audio, w tym fragmenty muzyki klasycznej, zostały pierwotnie nagrane w stereo. Sprawiało to zespołowi trudności podczas transformacji brzmienia kompozycji w epizodach interaktywnych. Aby uzyskać wysokiej jakości rezultat, specjaliści musieli pójść na liczne kompromisy i wprowadzić znaczące zmiany.

Ten przykład przedstawia kompozycję towarzyszącą potencjalnej śmierci postaci. Muzyka diegetyczna zaczyna grać za drzwiami, a następnie wkracza na scenę, stopniowo nabierając intensywności w różnych punktach lokacji. Tworzy to efekt dramatyczny i wzmacnia ładunek emocjonalny. Ostatecznie akompaniament muzyczny zakrywa całą scenę, podkreślając tragiczne zakończenie i potęgując siłę oddziaływania wydarzeń.

Wyniki

W ciągu 14 lat działalności firma Supermassive Games ugruntowała swoją pozycję jako jedna z wiodących brytyjskich firm zajmujących się grami, zdobywając liczne nagrody za osiągnięcia w dziedzinie kina interaktywnego i rzeczywistości wirtualnej. Wśród jej najbardziej znaczących projektów znajduje się Until Dawn, które w 2016 roku zdobyło nagrodę BAFTA za najlepszą oryginalną własność intelektualną. Antologia Dark Pictures: Little Hope również odbiła się szerokim echem, zdobywając w 2021 roku nagrodę NAVGTR za wybitne brzmienie. Krytycy chwalili innowacyjną rozgrywkę z mikrofonem kierunkowym w The Devil in Me, a NME nazwało nową mechanikę „zabójczym ASMR”. Supermassive Games nieustannie rozwija swoje unikalne podejście do tworzenia wciągających treści, potwierdzając swoją pozycję lidera w branży.

Barney podkreśla, że rozwiązania audio jego zespołu, w tym system foley, wyznaczyły wysokie standardy kilka lat temu. Dziś wielu deweloperów stosuje podobne metody, a niektóre studia osiągnęły poziom Supermassive Games. Nie oznacza to, że zespół Barney'a osiągnął perfekcję, ale opracowane systemy stały się ważną częścią „kinowego DNA”, co pozwala firmie co roku tworzyć treści klasy AAA.

Tworzenie treści grozy Tworzenie filmu bez straszenia z zaskoczenia to ciekawy i wymagający proces. Reżyser dźwięku Wasilij Kasznikow dzieli się przydatnymi wskazówkami, jak osiągnąć niezbędną atmosferę strachu i napięcia.

Pierwszym krokiem jest praca z dźwiękiem. Dźwięki otoczenia, takie jak skrzypienie podłóg, szelest wiatru czy odległe kroki, mogą wywołać u słuchacza poczucie niepokoju i niepewności. Użyj niskich częstotliwości i dysonansowych akordów, aby wywołać u słuchacza poczucie niepokoju.

Ważne jest również mądre stosowanie pauz. Cisza może być równie przerażająca jak dźwięk. Buduj napięcie i dramaturgię, pozostawiając momenty bez dźwięku. Pozwoli to widzowi poczuć się nieswojo i wzmocni ogólne wrażenie historii.

Nie zapomnij o postaciach. Ich wewnętrzne przeżycia i lęki można przekazać za pomocą formatów audio. Emocjonalny ciężar zawarty w dialogach i efektach dźwiękowych pomoże stworzyć głębszą więź z publicznością.

Warto pamiętać, że horror to nie tylko efekty wizualne, ale również percepcja dźwięku. Tworząc napięcie za pomocą dźwięku i atmosfery, możesz zanurzyć widzów w świecie horroru bez potrzeby stosowania tradycyjnych efektów typu jump scare.

Zawód projektanta gier od podstaw do poziomu PRO

Projektant gier tworzy strukturę gry. Przemyślą pomysł, zasady, rozgrywkę i zdecydują, jakie emocje fabuła wywoła u graczy. Opanujesz od podstaw zasady projektowania gier i nauczysz się pracować z popularnymi silnikami, takimi jak Unity i Unreal Engine. Dowiesz się, jak utrzymać zainteresowanie graczy i monetyzować gry. Pomożemy Ci rozpocząć karierę w branży gier.

Dowiedz się więcej