Spis treści:

Dowiedz się: Zawód animatora 3D

Dowiedz się więcejPodczas GDC 2022 Simon Habib, główny animator techniczny w Eidos Montreal, wygłosił prezentację na temat pełnego cyklu tworzenia animacji twarzy postaci w filmie Strażnicy Galaktyki Marvela. Szczegółowo opisał proces, od skanowania aktorów po integrację animowanych treści z grą. Zespół redakcyjny Gamedev firmy Skillbox Media dzieli się kluczowymi punktami z wystąpienia. Podczas oglądania filmów w tym artykule koniecznie włącz dźwięk, aby w pełni zrozumieć informacje.

W tym materiale znajdziesz informacje na temat:

- podstaw wizji animatorów Eidos Montreal;

- szczegółów fotogrametrii i procesów mocap;

- sposobu, w jaki zeskanowane dane są przenoszone na animację;

- sposobu, w jaki zespół znalazł równowagę między ilością a jakością, opracowując kryteria dla poziomów animacji brązowych, srebrnych i złotych.

Krótkie informacje o prelegencie i jego wkładzie w grę

W ciągu pierwszych dziesięciu lat swojej kariery Simon Habib specjalizował się w riggowaniu. Do jego obowiązków należało tworzenie rigów do animacji twarzy, postaci dwunożnych, zwierząt i pojazdów. Zajmował się również skinningiem, symulacją fizyki i opracowywaniem potoków dla riggerów. Doświadczenie Simona w tych obszarach pozwoliło mu znacząco poprawić jakość animacji i zoptymalizować przepływy pracy w studiach.

W 2015 roku Simon rozpoczął pracę nad animacją twarzy, dążąc do tworzenia wyjątkowych wrażeń z gier. Zainteresowanie grami opartymi na narracji zainspirowało go do stworzenia animacji, które przekazują autentyczne emocje postaci i tworzą więź emocjonalną z graczami. Projekt Strażnicy Galaktyki Marvela stał się idealną platformą do realizacji tego pomysłu, pozwalając mu zrealizować ambicje i zwrócić uwagę na znaczenie wysokiej jakości animacji w grach wideo.

Gra zebrała wysokie noty zarówno od krytyków, jak i użytkowników. Rock, Paper, Shotgun zauważył, że animacje twarzy postaci dorównują oryginalnym filmom Marvela. VG247 nazwał ją nawet jedną z najlepszych gier tego gatunku, jakie kiedykolwiek widział. Podkreśla to wysoką jakość grafiki i dbałość twórców o szczegóły, dzięki czemu gra przypadnie do gustu fanom zarówno gier wideo, jak i serii filmów Marvela.

Co kierowało zespołem Eidos Montreal podczas tworzenia animacji?

Praca nad Strażnikami Galaktyki Marvela rozpoczęła się od uświadomienia sobie, że jest to gra kładąca nacisk na narrację i zdjęcia. Skupia się ona na pięciu głównych bohaterach walczących ze sobą. Chociaż bohaterowie są stylizowani na swoich komiksowych odpowiedników, ważne było, aby byli wizualnie atrakcyjni, w tym antropomorficzni Rocket i Groot. Udało się to osiągnąć dzięki mistrzowskiemu odgrywaniu żywych emocji przez aktorów, co dodaje głębi i wiarygodności ich interakcjom. Ostatecznie gra łączy wciągającą historię z dynamiczną animacją, dzięki czemu jest atrakcyjna zarówno dla fanów gier, jak i komiksów.

Zespół przeanalizował istniejące w branży rozwiązania mocap i zidentyfikował cztery kluczowe innowacje techniczne. Innowacje te stały się podstawą do stworzenia animacji przyszłych postaci.

- Fotogrametria. Z reguły podczas tworzenia postaci artyści tworzą nowe obrazy w oparciu o odniesienia. Fotogrametria umożliwia uzyskanie gotowego, zeskanowanego wyglądu prawdziwej osoby, co doskonale nadaje się jako podstawa dla przyszłego bohatera.

- Animacja oparta na nagraniu wideo. Wiele gier wykorzystuje ścieżki dźwiękowe do tworzenia animacji twarzy. Za pomocą dźwięku można osiągnąć precyzyjną synchronizację ruchów ust, ale pojawia się pytanie, jak dostosować resztę mięśni twarzy do takiej animacji. Zazwyczaj w tym procesie stosuje się generowanie proceduralne, co nie zawsze daje satysfakcjonujące rezultaty. W przypadku animacji opartej na wideo mimika postaci jest bardziej żywa i wyrafinowana.

- Posiadanie własnego studia mocap i zatrudnianie lokalnych aktorów. Wynajem studia zawsze spowalnia produkcję, ponieważ trzeba uwzględnić czas potrzebny na rezerwację sesji i przetwarzanie przechwyconych danych.

- Zalety pełnego przechwytywania ruchu. Zazwyczaj wielu twórców gier nagrywa mocap i narrację osobno, a następnie łączy wszystkie dane podczas montażu przerywników filmowych. Jednak takie podejście nie zawsze gwarantuje integralność ujęcia. Podczas produkcji gry Strażnicy Galaktyki studia Marvel głosy, twarze i ruchy aktorów nagrywano jednocześnie, co zapewniało maksymalną synchronizację i naturalność.

Twórcy często stają przed dylematem między ilością a jakością. Podczas tworzenia animacji twarzy postaci w Strażnikach Galaktyki Marvela zespół udowodnił, że możliwe jest osiągnięcie kompromisu poprzez podzielenie treści na różne poziomy jakości. Pozwala to na utrzymanie wysokich standardów animacji bez poświęcania objętości treści. Takie podejście nie tylko poprawia doświadczenia użytkownika, ale także optymalizuje procesy produkcyjne w branży gier.

- Poziom brązowy obejmuje stworzenie w pełni zautomatyzowanego szkieletu, który praktycznie nie wymaga ręcznego udoskonalania. Ten typ animacji jest tworzony za pomocą uczenia maszynowego z późniejszym doborem emocji dla każdej kwestii. Takie animacje były wykorzystywane w dialogach w grze.

- Poziom srebrny jest najbliższy oryginalnej grze aktorskiej, ale wymaga technicznego i artystycznego dopracowania przez specjalistów, aby go osiągnąć. Jest on wykorzystywany w większości przerywników filmowych.

- Poziom złoty osiąga się poprzez udoskonalenie srebrnych animacji bezpośrednio w silniku. Używane w kluczowych momentach gry i w materiałach promocyjnych.

Po zapoznaniu się z podstawowymi zasadami pracy animatorów w Eidos Montreal, warto przyjrzeć się bliżej każdemu etapowi ich pracy. Ta analiza pomoże zrozumieć metody i techniki stosowane w animacji oraz ich wpływ na produkt końcowy. Etapy pracy animatorów obejmują rozwój koncepcji, klatki kluczowe oraz animację końcową i optymalizację. Każdy z tych etapów odgrywa kluczową rolę w tworzeniu wysokiej jakości animacji, spełniającej wysokie standardy branży gier wideo. Zrozumienie tych procesów pozwoli na głębsze docenienie pracy animatorów i ich wkładu w tworzenie unikalnych wrażeń z gry.

Proces fotogrametrii

Fotogrametria to metoda uzyskiwania wielu skanów obiektu pod różnymi kątami w celu stworzenia modelu 3D. W filmie Strażnicy Galaktyki Marvela zastosowano stylizowaną grafikę, co pozwoliło uniknąć całkowitego przeniesienia wyglądu aktorów na modele postaci. Zespół deweloperski musiał podjąć decyzję: wybrać odpowiedniego aktora i stworzyć grafikę koncepcyjną postaci na podstawie jego wyglądu, czy zacząć od projektu, a następnie wybrać model pasujący do narysowanego obrazu. Ostatecznie animatorzy wybrali to drugie podejście. To rozwiązanie pozwoliło nam stworzyć wyjątkowe postacie, które idealnie wpasowują się w styl gry.

Aktorzy zostali zeskanowani w specjalistycznej kabinie zbudowanej przez Pixel Light Effects. W tej wyjątkowej przestrzeni wykorzystano jednocześnie 40 lustrzanek cyfrowych, a pięć softboxów zapewniało wysokiej jakości, rozproszone oświetlenie, eliminując ostre cienie. Zespół przeprowadził 13 sesji skanowania, po jednej dla każdej postaci, co pozwoliło im na stworzenie wysokiej jakości modeli 3D do wykorzystania w filmach i grach wideo.

Przed rozpoczęciem zdjęć, na twarze modelek nałożono około 100 markerów z czarnym eyelinerem. Pozwoliło to twórcom postaci na dokładniejsze śledzenie zmian mięśni twarzy w trakcie procesu. Modelki prezentowały 25 różnych emocji, co stanowiło podstawę do stworzenia 138 kształtów mieszanych, niezbędnych do późniejszego riggowania. Zastosowanie takich technologii znacząco poprawia jakość animacji i realizm postaci w projektach wirtualnych.

Technicznie rzecz biorąc, fotogrametria to proces wykorzystujący zdjęcia do uzyskiwania precyzyjnych pomiarów obiektów i terenu. Proces ten polega na rejestrowaniu obrazów pod różnymi kątami, co pozwala na stworzenie trójwymiarowego modelu badanego obiektu. Kluczowym krokiem jest przetwarzanie uzyskanych obrazów za pomocą specjalistycznego oprogramowania, które analizuje dane i rekonstruuje parametry geometryczne. Dzięki temu fotogrametria zapewnia wysoką dokładność i szczegółowość, co czyni ją niezbędnym narzędziem w takich dziedzinach jak architektura, geodezja i kartografia. Skuteczność fotogrametrii zależy również od jakości zdjęć źródłowych i użytego sprzętu, co podkreśla znaczenie odpowiedniego przygotowania przed sesją.

- Obrazy .cr2 otrzymane z aparatów zostały poddane korekcji kolorów i tonów w programie Lightroom Classic.

- Edytowane obrazy zostały następnie przeniesione do programu RealityCapture, który generuje chmurę punktów obiektów na obrazie i tworzy z nich bardzo szczegółowe siatki. Specjaliści następnie zautomatyzowali ten proces.

- Następnie zespół przekonwertował powstałe siatki do Wrap3, przeniósł je do bazowej siatki postaci, a następnie sfinalizował stylizację i dodał akcenty w ZBrush.

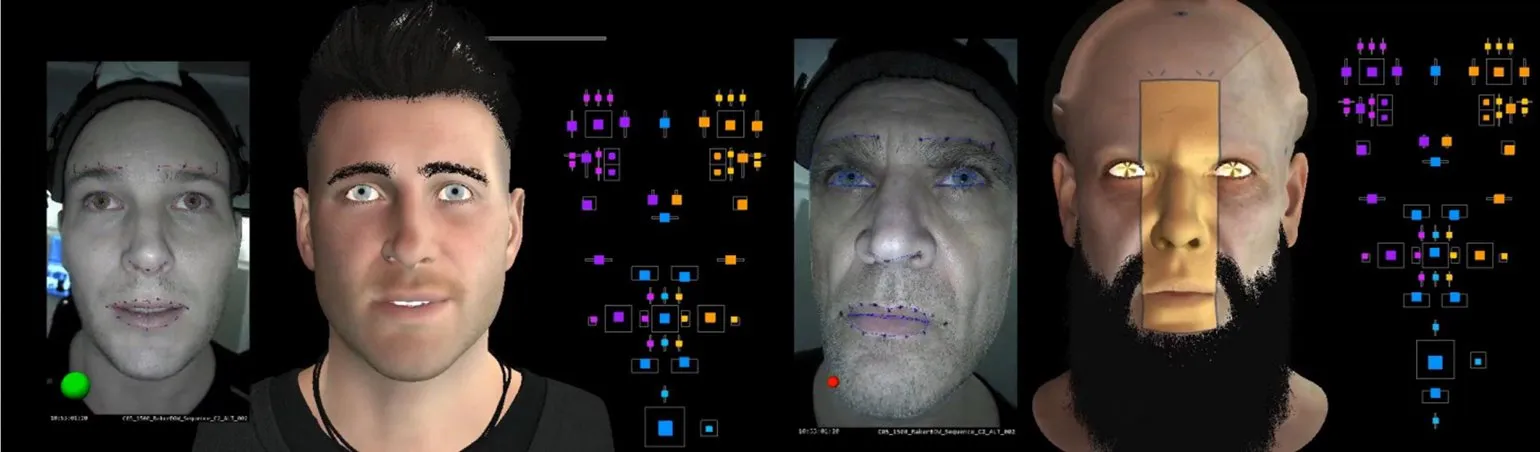

Poniższa animacja, stworzona przy użyciu funkcji blendshapes w programie Maya, demonstruje wstępną fazę testów. Głównym celem było jak najdokładniejsze odtworzenie modelu cyfrowego, wiernie odzwierciedlającego wygląd prawdziwej osoby, przed rozpoczęciem procesu stylizacji. Dzięki temu podejściu możemy osiągnąć wysoki stopień realizmu i dokładności animacji postaci, co jest kluczowe dla tworzenia przekonujących efektów wizualnych w projektach cyfrowych.

W prawym górnym rogu można zobaczyć różnorodne emocje prezentowane przez aktora. Poniżej znajduje się zbiór emocji stworzonych na podstawie blendshape'ów. Te elementy wizualne pomagają lepiej zrozumieć zakres ekspresji postaci i ich stan emocjonalny, co przyczynia się do głębszego odbioru treści.

Przechwytywanie ruchu

W grze Marvel's Guardians of the Galaxy twórcy zastosowali trzy różne metody przechwytywania ruchu. Przyjrzyjmy się bliżej każdej z nich. Technologie te pozwalają na tworzenie realistycznych animacji postaci, poprawiając interakcję i immersję w rozgrywce. Wykorzystanie różnych podejść do przechwytywania ruchu pomaga głębiej ukazać osobowości postaci i nadaje grze niepowtarzalny styl.

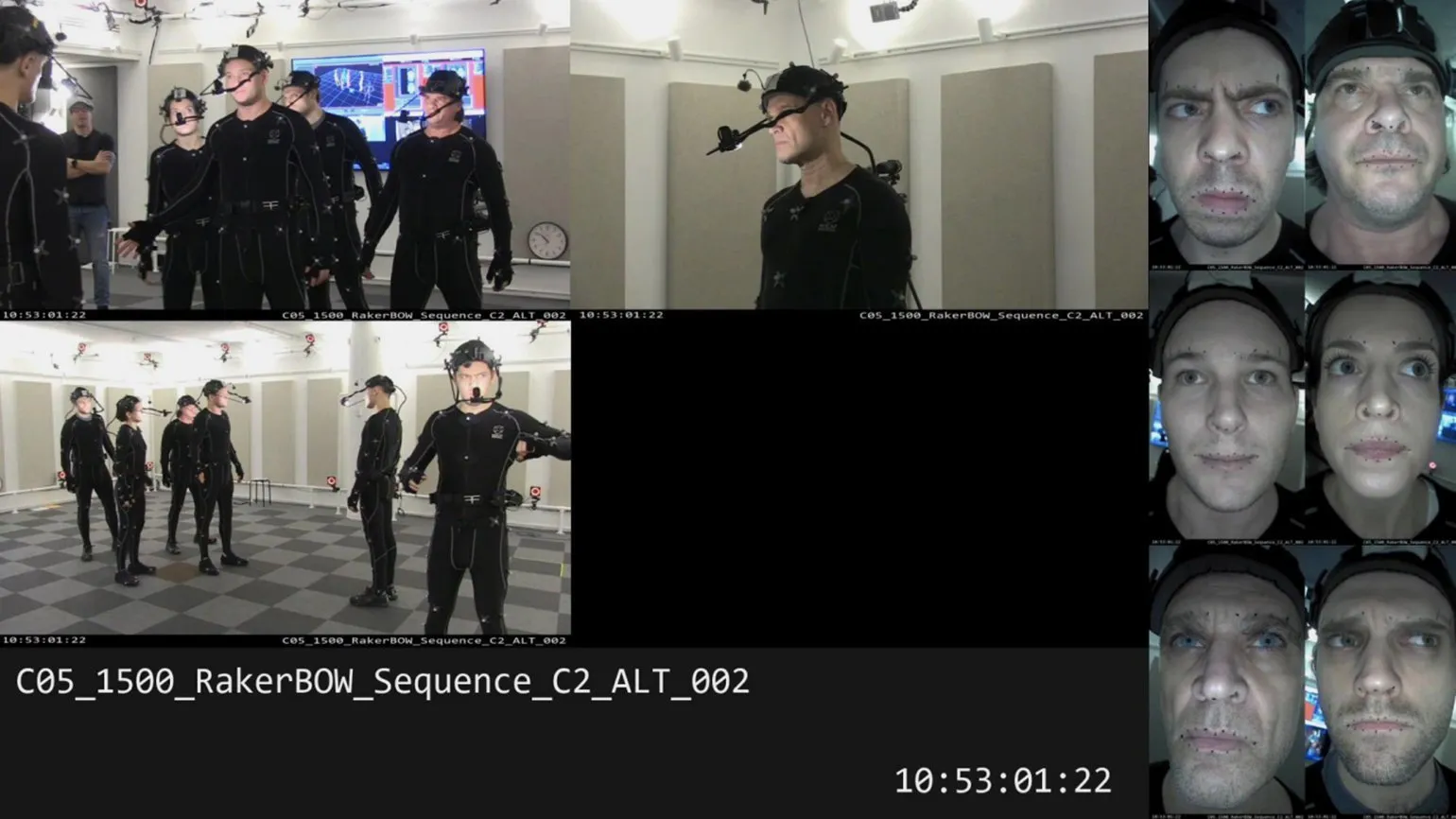

Pokazany obraz przedstawia pomieszczenie, w którym odbywały się wszystkie sesje mocap do przerywników filmowych. Pomieszczenie to zostało specjalnie przygotowane do nagrywania ruchów aktorów, co pozwoliło na stworzenie realistycznych animacji i poprawę jakości przerywników filmowych projektu.

Przestrzeń Eidos Montreal, choć mniejsza niż hale innych studiów AAA, okazała się idealna do nagrywania dialogów, prostych ruchów i akrobacji w sesjach mocap. W sesjach tych mogło uczestniczyć jednocześnie do siedmiu osób. Prawie wszyscy uczestnicy mieli na sobie specjalne uchwyty z kamerami zamontowanymi przed twarzą aktora, co pozwalało na uchwycenie jego mimiki na wideo. Studio miało w swoim arsenale tylko sześć takich urządzeń, co podkreśla wyjątkowość i skuteczność ich podejścia do procesu nagrywania.

Motion capture został zarejestrowany za pomocą systemu OptiTrack, natomiast animacja twarzy została wykonana w technologii Faceware. Na załączonym zdjęciu widać, że wszyscy aktorzy, ubrani w zestawy słuchawkowe, mieli do swoich urządzeń podłączone małe mikrofony. Pozwoliło to zespołowi na nagrywanie ścieżek audio bezpośrednio podczas filmowania, co znacznie uprościło późniejsze łączenie plików audio i synchronizację z treściami wizualnymi. Takie podejście zapewnia wysoką jakość dźwięku i integrację elementów audiowizualnych, co jest ważnym aspektem w procesie tworzenia projektów multimedialnych.

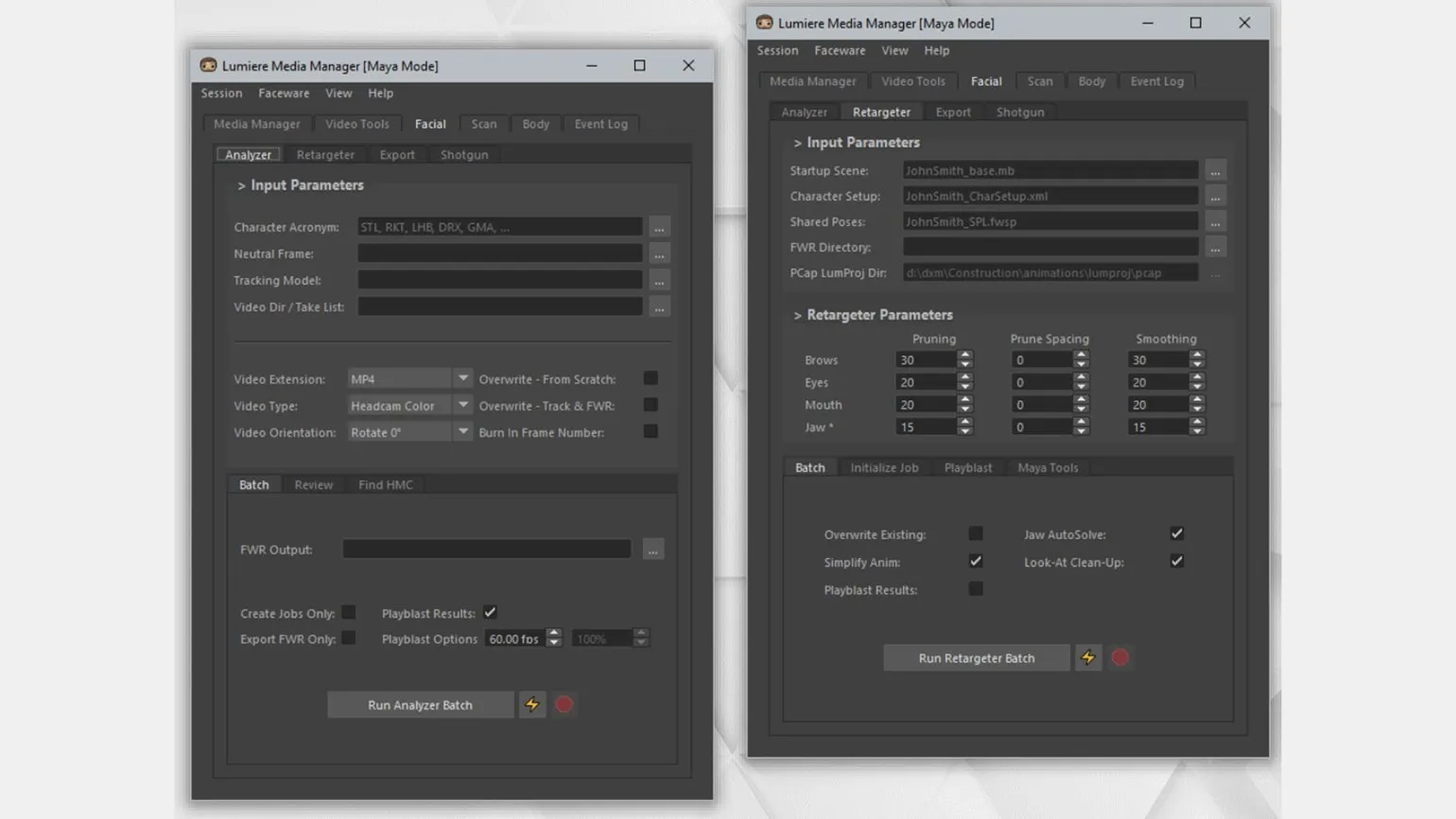

Podczas filmowania kluczowym aspektem była synchronizacja danych motion capture i animacji twarzy aktorów, a także ścieżek audio i trzech kamer referencyjnych zainstalowanych na obwodzie pomieszczenia. W tym celu zastosowano wspólne kody czasowe. Konieczne było również zapewnienie jednoczesnego nagrywania na wszystkich urządzeniach i uporządkowanie plików w określonej kolejności. Aby sprostać tym wyzwaniom, zespół opracował niestandardową wtyczkę Lumiere, która znacznie uprościła proces i zwiększyła jego wydajność.

Podczas sesji nagrywania mocap obecnych było około pięciu kluczowych członków personelu: producent, reżyser przerywników filmowych, specjalista mocap, inżynier dźwięku i sam Simon. Na planie byli również asystenci, którzy pomagali aktorom w zakładaniu kostiumów mocap. Zapewniło to wysoką jakość nagrań i precyzyjny ruch postaci, co jest kluczowe dla stworzenia realistycznego doświadczenia w grach. Każdy uczestnik odegrał wyjątkową rolę w osiągnięciu końcowego rezultatu, podkreślając wagę pracy zespołowej w produkcji gier wideo.

Pomimo komfortowych warunków filmowania, ostatni rok produkcji okazał się stresujący. Pandemia wymusiła szereg ograniczeń i ścisłych wytycznych dotyczących dystansu społecznego, w tym noszenie maseczek i osłon ochronnych, a także regularne stosowanie środków do dezynfekcji rąk. W studiu zainstalowano kamerę, aby rejestrować wszystko, co działo się na planie. Nagrania były w razie potrzeby przesyłane strumieniowo za pośrednictwem Zoom, co pozwoliło personelowi na zdalne zarządzanie procesem filmowania z domu i przekazywanie natychmiastowych informacji zwrotnych za pośrednictwem Slacka. Zapewniło to skuteczną komunikację i ciągłość pracy podczas pandemii.

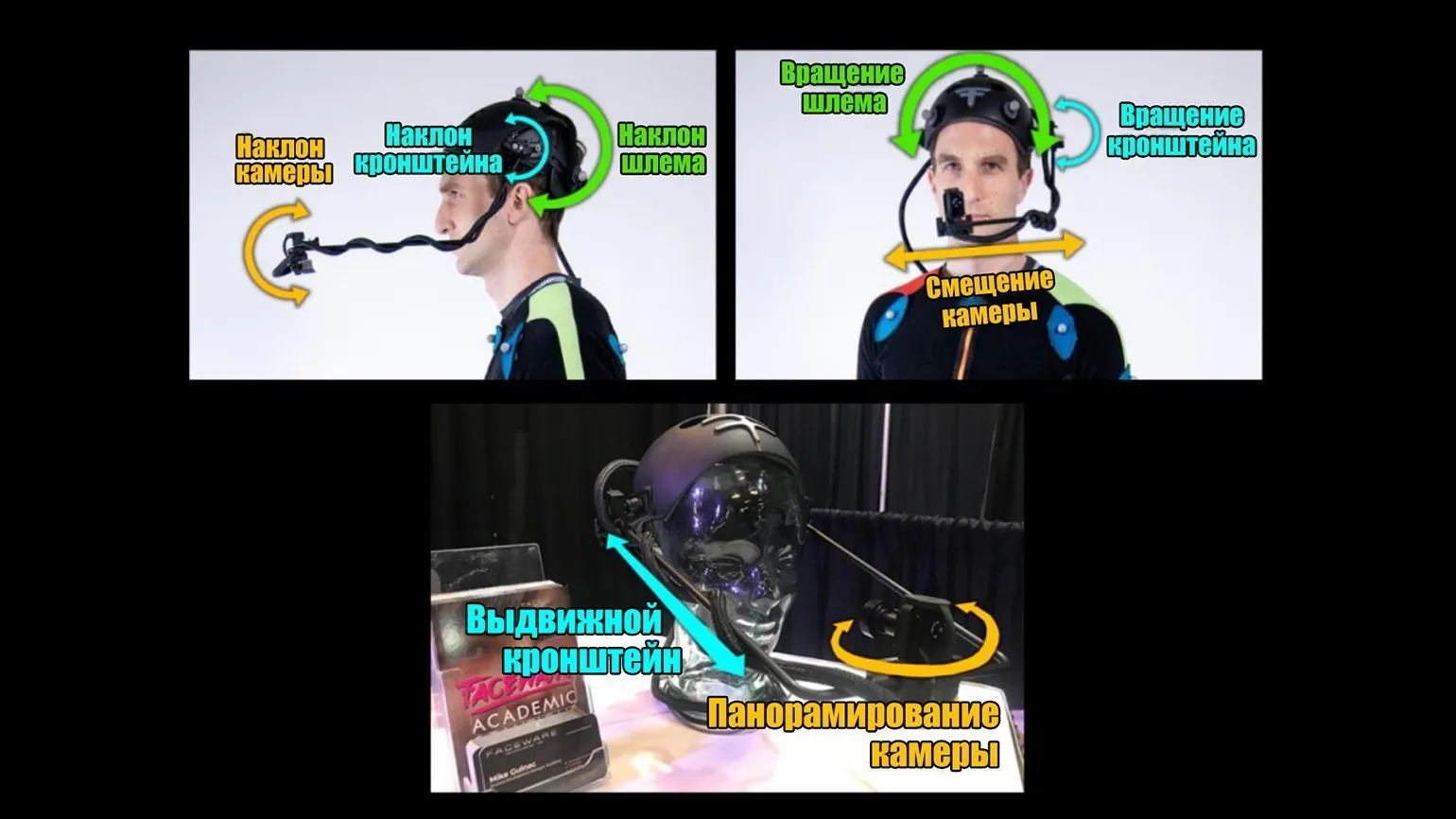

Pokazany tutaj kolaż przedstawia kamerę Faceware Mark III zamontowaną na hełmie. Chociaż Mark III był dostępny podczas prac nad Strażnikami Galaktyki Marvela, animatorzy z Eidos Montreal wybrali do swojej pracy kamerę Mark III. Ta decyzja odzwierciedla wysoki poziom zaufania do sprawdzonej technologii, która nadal jest wykorzystywana w animacji do osiągania wysokiej jakości rezultatów.

Zamontowana na hełmie kamera RGB nagrywała w rozdzielczości 720p z prędkością 60 klatek na sekundę. Podświetlenie LED, umieszczone pod kamerą i o regulowanej jasności, skutecznie zmiękczało ostre światło pochodzące ze źródeł światła tła, minimalizując powstawanie cieni. Aby uzyskać precyzyjną kalibrację, na twarzy aktora zaznaczono 27 kluczowych punktów, co umożliwiło śledzenie twarzy za pomocą specjalistycznego oprogramowania, podobnego do procesu fotogrametrii. Zapewniło to wysoki poziom szczegółowości i precyzję w przekazywaniu emocji, co jest szczególnie ważne w grafice komputerowej i animacji.

Specjaliści regularnie włączali tryb nakładania siatki na monitorach, aby zapewnić stabilność zestawu słuchawkowego i precyzyjne wyśrodkowanie twarzy aktora w kadrze. Pomiędzy ujęciami zespół regulował ostrość obiektywów, aby zapewnić klarowność obrazu, co ułatwiało skuteczniejsze śledzenie. Takie podejście gwarantowało wysoką jakość obrazu i dokładne uchwycenie ruchów aktorów.

Podczas filmowania szczególną uwagę poświęcono komfortowi aktorów, a kamera Mark III z powodzeniem spełniła ten wymóg. Jej niewielka waga sprawiła, że korzystanie z niej było znacznie wygodniejsze niż w przypadku podobnych urządzeń. Nisko umieszczona przednia kamera i źródła światła nie ograniczały widoczności aktorów, pozwalając im na swobodniejsze i bardziej naturalne odgrywanie ról. Stworzyło to sprzyjającą atmosferę na planie i przyczyniło się do wysokiej jakości wykonania zadań.

Obraz po prawej przedstawia sześć pionowych filmów nagranych przednią kamerą. W centrum znajduje się wybór klatek z trzech kamer referencyjnych. Na dole znajduje się tytuł filmu i kod czasowy, niezbędny do synchronizacji wszystkich plików multimedialnych, w tym oddzielnie nagranych ścieżek audio. Takie podejście gwarantuje wysoką jakość końcowego materiału i upraszcza proces edycji.

Fragmenty wideo są łączone za pomocą zautomatyzowanego skryptu wykorzystującego polecenia FFmpeg. Reżyser przerywników filmowych analizuje otrzymane materiały i wybiera najlepsze ujęcia, aby stworzyć pierwszy montaż roboczy. Ten proces zapewnia wysoką jakość i płynne przejścia między scenami, co jest ważne dla finalnego produktu.

W Guardians of the Galaxy zastosowano unikalną metodę nagrywania kwestii aktorskich zwaną „sesjami rozmów”. W przeciwieństwie do tradycyjnego podejścia, w którym aktorzy nagrywali swoje kwestie oddzielnie w odizolowanych kabinach, w Guardians of the Galaxy od Marvela pracowali oni w tym samym pomieszczeniu. Pozwoliło to aktorom na interakcję ze sobą, znacząco wzmacniając chemię między postaciami. Ta metoda nagrywania dialogów przyczyniła się do bardziej szczerych i dynamicznych rozmów, dzięki czemu fabuła gry stała się bardziej angażująca i żywa. Wykorzystanie „sesji rozmów” w projekcie podkreśla znaczenie pracy zespołowej w procesie aktorskim i pokazuje, jak interakcja może poprawić jakość produktu końcowego.

Nagrano 23 000 linii dialogowych, co stanowiło podstawę do stworzenia wysokiej jakości zawartości gry. Podczas filmowania aktorzy nosili specjalne hełmy z kamerą umieszczoną z przodu, co umożliwiało rejestrowanie ich mimiki i emocji. Nagrany materiał wideo został wykorzystany do opracowania animacji twarzy postaci w różnych sytuacjach rozgrywki, w tym podczas poruszania się w lokacjach, scen walki i dialogów w grze. Aby dokładnie dopasować ścieżkę audio do odpowiadających jej fragmentów wideo, specjaliści wykorzystali metadane kodu czasowego osadzone w plikach audio. Ten proces zapewnił wysokiej jakości synchronizację i realistyczne interakcje postaci.

Chociaż nagranie wideo uchwyciło wszystkie niuanse mimiki twarzy, animatorzy polegali głównie na dolnych partiach mięśni twarzy do synchronizacji ruchu ust. Pełne dane uzyskane z twarzy aktorów zostały załadowane do systemu uczenia maszynowego, który analizował i śledził różnorodne emocje. Takie podejście pozwala na uzyskanie bardziej realistycznej animacji, co przekłada się na lepszą jakość interakcji między postaciami a publicznością. Wykorzystanie nowoczesnych technologii w animacji przyczynia się do dokładniejszego oddania emocji, co znacząco zwiększa poziom zaangażowania widzów.

Dialogi w grze są zazwyczaj nagrywane za pomocą mikrofonów stałych lub na wysięgnikach, co ogranicza swobodę ruchów aktorów. Jednak w przypadku dubbingu w Strażnikach Galaktyki Marvela zastosowano innowacyjne podejście: wykorzystano mikrofony montowane na hełmach. Pozwoliło to aktorom na swobodne poruszanie się podczas nagrywania, co znacznie poprawiło naturalność ich występów bez wpływu na jakość dźwięku. Ta metoda nagrywania dialogów była ważnym krokiem w tworzeniu bardziej dynamicznego i wciągającego doświadczenia gry.

Pomimo długości zdjęć, na planie panowała przyjazna atmosfera. Simon podkreśla, że aktorzy często śmiali się i żartowali podczas pracy. Było wyraźnie widać, że czerpali przyjemność z odgrywania ról i całkowicie się w nie angażowali. Stworzyło to wyjątkową atmosferę sprzyjającą procesowi twórczemu i poprawiło jakość finalnego produktu.

Trzecim i ostatnim rodzajem techniki motion capture stosowanym przez zespół jest przechwytywanie emocji. Podczas tych sesji animatorzy prosili aktorów o przekazanie szerokiej gamy emocji o różnym stopniu intensywności. Powstała treść została podzielona na cztery główne grupy stanów emocjonalnych postaci: radość, złość, nerwowość i smutek. Takie podejście pozwala na tworzenie bardziej realistycznych i ekspresyjnych animacji, co z kolei poprawia jakość finalnego produktu i interakcję widzów z postaciami.

Podczas komunikacji ludzie wyrażają swoje emocje nie tylko słowami, ale także gestami niewerbalnymi. Dotyczy to zarówno mówców, jak i słuchaczy, ponieważ gesty mogą zależeć od pozycji ciała. Mając to na uwadze, aktorzy zostali sparowani, aby nagrywać rozmowy w różnych pozach – zarówno stojących, jak i siedzących. W rezultacie animatorzy uzyskali obszerny zbiór gestów uchwyconych w różnych pozycjach. Ta różnorodność pozwala na lepsze oddanie tonu emocjonalnego interakcji w animacji, czyniąc je bardziej realistycznymi i ekspresyjnymi. Mimika uchwycona podczas rozmów może być skutecznie wykorzystana do śledzenia emocji za pomocą uczenia maszynowego. Pozwala to na określenie intensywności stanu emocjonalnego postaci. Program automatycznie wybiera odpowiednie animacje z biblioteki i stosuje je do górnej części twarzy i gestów. Aby uzyskać więcej informacji na temat tego procesu, zalecamy przeczytanie raportu kolegi Simona, Romaina Trachela.

Film pokazuje, że ruchy ust, w tym ruchy postaci antropomorficznej, są zsynchronizowane z wypowiadanymi kwestiami. Spojrzenie, szyja i tułów postaci automatycznie zwracają się w stronę mówcy. Ten proces jest przeprowadzany automatycznie, a Simon ocenia go jako brązowy.

Przetwarzanie wsadowe

Trzy typy sesji zostały przetworzone na animację za pomocą przetwarzania wsadowego. Ten tryb analizuje tysiące filmów, automatycznie identyfikując odpowiednie animacje twarzy dla aktora i stosując je do odpowiedniego szkieletu postaci. Aby program mógł skutecznie rozpoznawać mimikę twarzy, wymagane jest szkolenie. Aby zapewnić dokładne dopasowanie animacji do konkretnej postaci cyfrowej, dla każdego aktora tworzony jest unikalny profil.

Uczenie maszynowe zostało wykorzystane do opracowania modelu śledzenia, który jest zestawem mimiki twarzy i kształtów ust. Model ten rejestruje dane zbierane przez kamerę w trakcie nagrywania. Optymalizacja mimiki twarzy i śledzenia ruchu ust poprawia dokładność analizy i interakcji użytkownika, co jest ważne w przypadku aplikacji rzeczywistości wirtualnej i animacji.

Simon podkreśla, że w uczeniu maszynowym konieczne jest przestrzeganie zasady „mniej znaczy więcej”. Oznacza to wybieranie tylko tych klatek treningowych, w których mimika twarzy osiąga szczyt. Wykluczając niepotrzebne klatki, można uniknąć przeciążenia procesu, co uprości interpolację między różnymi mimikami w programie. Kluczem jest zachowanie spójności. Jeśli zostaną wykryte rozbieżności w podobnych wyrazach, algorytm może nie być w stanie przetworzyć tych danych, co doprowadzi do niewiarygodnych wyników śledzenia. Prawidłowe podejście do wyboru klatek treningowych i dbałość o szczegóły odgrywają kluczową rolę w skutecznym zastosowaniu technologii uczenia maszynowego do analizy mimiki twarzy.

Po przetworzeniu filmu animatorzy wykorzystali wtyczkę Faceware Retargeter do Maya, aby stworzyć bibliotekę póz z odpowiadającymi im mimikami dla cyfrowych postaci. Biblioteka zawiera różnorodne, bardzo wyraziste emocje, a także bardziej umiarkowane opcje rozszerzające zakres. Zespół wziął również pod uwagę drobne asymetrie w mimice, co przyczyniło się do naturalności zdjęcia. W rezultacie powstało 20 unikalnych profili postaci, opracowanych przy użyciu technologii Faceware, co znacznie poprawia realizm i ekspresję animacji.

Nagrywanie różnych mimiki twarzy

Aby stworzyć każdy profil w Faceware, zespół nagrał ROM twarzy, który odzwierciedlał różne mimiki. Proces ten obejmował skrupulatne przechwytywanie ruchu twarzy, co pozwoliło na dokładne odwzorowanie ekspresji i emocji. Wysokiej jakości nagrywanie animacji twarzy stało się kluczowym krokiem w rozwoju wiarygodnych postaci cyfrowych. Takie podejście zapewnia wysoki poziom realizmu i szczegółowości animacji, co jest szczególnie ważne w grach i filmach. Wykorzystanie ROM twarzy pozwala zespołowi Faceware tworzyć unikalne profile, dopasowane do indywidualnych cech każdej postaci, zwiększając ogólny poziom immersji w wirtualnym świecie.

Aktorzy z grupy wykonywali zadania przedstawiające różnorodne emocje. Sesja nagraniowa rozpoczęła się od prostych ruchów oczu, brwi i ust, stopniowo przechodząc do pełnego zaangażowania wszystkich mięśni twarzy, aby stworzyć bardziej złożone emocje. Cały proces nagrywania trwał około pięciu minut.

Nagrania przeprowadzone w celu stworzenia profili postaci ujawniły również dodatkowe korzyści. Po pierwsze, zapewniają one doskonałą rozgrzewkę wokalną dla aktorów na początku dnia pracy, co pomaga im lepiej się przygotować. Po drugie, takie sesje pozwalają na sprawną regulację dźwięku i testowanie jednoczesnego wyzwalania nagrywania na wielu urządzeniach z wykorzystaniem wbudowanego kodu czasowego. Zapewnia to wysoką jakość nagrania i synchronizację, co jest szczególnie ważne w późniejszej postprodukcji.

Zespół Eidos Montreal przywiązywał szczególną uwagę do nagrywania mimiki twarzy przed każdą sesją, nawet jeśli nie planowano nowych ujęć postaci. Niektóre postacie korzystały z tego samego profilu animacji twarzy opracowanego na wczesnym etapie projektu. Nowe profile tworzono dopiero po dołączeniu nowych aktorów, gdy zachodziła konieczność dostosowania ich mimiki do postaci cyfrowych. Zapewniło to wysokiej jakości animację i realistyczne interakcje między postaciami w grze.

Udoskonalenie filmowe

Na tym etapie przeprowadzono udoskonalenie istniejących animacji, zarówno pod względem technicznym, jak i artystycznym. Celem tych udoskonaleń było osiągnięcie maksymalnej dokładności i wiarygodności rezultatu.

Simon i trzech innych specjalistów z działu scen przerywnikowych wykonali różne zadania związane z przechwytywaniem ruchu. Pomagali aktorom w korzystaniu z narzędzi mocap i konfigurowaniu profili w MotionBuilder. Po zakończeniu przechwytywania ruchu, animacje zostały przetworzone i przeniesione do odpowiedniego narzędzia w celu dalszej integracji z projektem.

Animacje twarzy wykorzystywały profile Faceware oparte na szeregu mimik twarzy. Ta metoda umożliwiła przetwarzanie wsadowe animacji poziomu brązowego, co znacznie zwiększyło wydajność i jakość tworzenia treści animowanych. Korzystanie z Faceware pozwala na tworzenie realistycznych i ekspresyjnych animacji, co jest szczególnie ważne w przypadku projektów z branży gier i filmu.

Tworzenie animacji twarzy na poziomie srebrnym obejmowało dwa kluczowe etapy. Na etapie technicznym zespół dążył do osiągnięcia maksymalnej wierności mimiki aktorów. Ponieważ system Faceware nie rejestruje ruchów języka, ten element był animowany za pomocą klatek kluczowych w scenach ze zbliżeniami postaci. Na etapie artystycznym zespół skupił się na mimice w sytuacjach komicznych i dodał elementy asymetryczne uzyskane w procesie przetwarzania wsadowego. Takie podejście pozwoliło na uzyskanie bardziej żywych i ekspresyjnych animacji, znacznie poprawiając jakość produktu końcowego.

Na filmie można zobaczyć dwie wersje tej samej animacji twarzy. Po lewej stronie znajduje się animacja brązowa, stworzona automatycznie bez dalszej obróbki ręcznej. Po prawej stronie znajduje się animacja srebrna, która przeszła zarówno obróbkę techniczną, jak i artystyczną. Te dwa podejścia do animacji podkreślają różnice w jakości i szczegółowości, co pozwala lepiej zrozumieć proces ulepszania efektów wizualnych.

Specjaliści zoptymalizowali mimikę twarzy każdej postaci z osobna w pustej scenie bez rekwizytów. Ta technika pozwoliła im osiągnąć maksymalną liczbę klatek na sekundę i skupić się wyłącznie na animacji postaci, eliminując rozpraszające elementy otoczenia. To podejście zapewnia wysoką jakość animacji i poprawia ogólną wydajność projektu.

W lewym dolnym rogu pionowych filmów znajduje się kolorowy okrąg, który służy specjalistom jako ważny wskaźnik. Pomaga on zidentyfikować i dostosować rig, gdy twarz aktora wykracza poza średnie zbliżenie. Ten element wizualny pozwala na dokładniejsze regulacje i lepszą jakość wideo, przyczyniając się do osiągnięcia profesjonalnego rezultatu.

Po skompletowaniu danych mocap i animacji na poziomie srebrnym, zespół przekazał gotowe zasoby animatorom scen przerywnikowych. Ci specjaliści dopracowali animację bezpośrednio w silniku gry, doprowadzając ją do jakości na poziomie złotym. Zmontowali sceny, wypełniając je postaciami, obiektami i pojazdami, a następnie ustawili kamery pod pożądanymi kątami, aby uzyskać maksymalny efekt wizualny. Finalna treść została wykorzystana nie tylko w przerywnikach filmowych, ale także w materiałach marketingowych, co przyczyniło się do wzrostu zainteresowania projektem i jego skutecznej promocji.

Specjaliści od przerywników filmowych pracowali również nad animacją antropomorficznych stworzeń i zwierząt, dla których nie było możliwe zastosowanie techniki mocap z udziałem człowieka. Na przykład, tworząc animację postaci Cosmo, zespół nie użył techniki mocap do twarzy psa. Zamiast tego w kilku scenach pojawił się czworonożny asystent Diego, wyposażony w specjalny sprzęt do przechwytywania ruchu. Pozwoliło nam to uzyskać realistyczną animację i zachować unikalne cechy postaci.

Proporcje postaci antropomorficznych znacznie różnią się od proporcji prawdziwych ludzi. Dlatego animatorzy ręcznie udoskonalają szkielety postaci takich jak Rocket. To ręcznie wykonane dzieło pozwala na bardziej naturalny ruch i ekspresję, co jest kluczowe dla animacji. Odpowiednie ustawienie platformy pomaga stworzyć unikalny styl i osobowość postaci, czyniąc ją bardziej angażującą dla widzów.

Rezultaty

Simon i jego zespół wykonali znaczną ilość pracy, zachowując równowagę między ilością a jakością. Koncentrują się na osiąganiu wysokich standardów, co pozwala im tworzyć produkty spełniające wymagania rynku. Ta równowaga jest kluczem do sukcesu, pozwalając zespołowi nie tylko zwiększyć wolumen produkcji, ale także utrzymać wysoki poziom zadowolenia klienta.

W wyniku 13 sesji skanowania opracowano 13 unikalnych modeli postaci w grze, każdy wyposażony w anatomicznie poprawne kształty. Modele te zapewniają wysoki poziom realizmu i szczegółowości, wzmacniając interakcję gracza ze światem gry.

Dzięki technologii Faceware stworzono 20 unikalnych profili, które następnie wykorzystano do przetwarzania wsadowego. Profile te znacząco poprawiają jakość renderowania i animacji twarzy, zapewniając wysoką dokładność i realizm w efektach końcowych.

Na podstawie 23 000 linii dialogowych z gry opracowano 99,9% wysokiej jakości animacji twarzy, w tym mimikę postaci w scenach walki, podczas dialogów i poruszania się po lokacjach gry. Pozostałe 0,01% animacji zostało ręcznie dopracowanych, aby uzyskać idealny efekt. Ta dbałość o szczegóły pozwala na bardziej realistyczne interakcje z postaciami i poprawia ogólne wrażenia z gry.

W rezultacie stworzono ponad pięć godzin przerywników filmowych, w tym alternatywne wątki fabularne. Animacje prezentowane są w proporcji 90% jakości srebrnej i 10% jakości złotej.

Animatorzy Eidos Montreal dążą do poprawy jakości animacji opartych na technologii mocap. Planują wdrożyć możliwość udoskonalania treści, które nie osiągnęły jeszcze poziomu złota, bezpośrednio w scenie. Ta innowacja znacznie przyspieszy proces pracy dzięki możliwości podglądu animacji w silniku gry z zainstalowanym oświetleniem i shaderami, co jest bardziej wydajne w porównaniu z renderowaniem wstępnym w Maya.

Zawód Animator 3D

Będziesz Naucz się tworzyć i animować modele 3D o dowolnej złożoności. Opanuj popularne programy i zasady animacji, a my pomożemy Ci znaleźć pracę w studiu lub zlecenia freelance.

Dowiedz się więcej